本記事は マクニカ、DataStax、NVIDIA の 3 社で共同執筆しています。

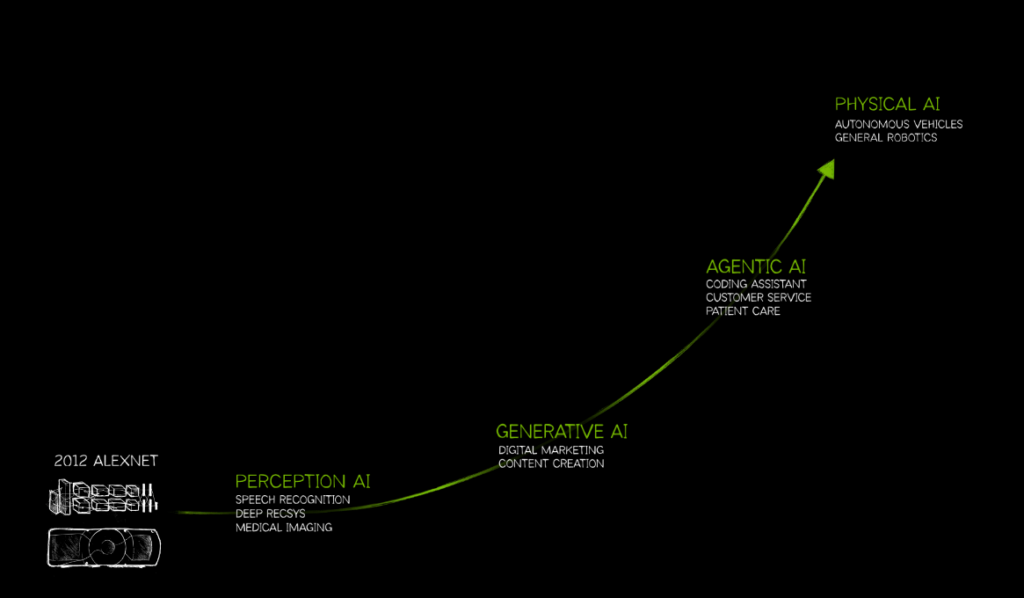

AI エージェントとは、複數の AI や Tool を組み合わせ、従來の AI ではできない複雑なタスクや複數のタスクを自律的に実行するための高度なシステムです。AI エージェントは設定された環境やフィードバックを基にタスクを実行し、データの分析、意思決定の支援、問題解決など、様々なタスクを実行します。CES 2025 や GTC 2025 にて、NVIDIA の CEO Jensen Huang はこれまでの RAG のシステムを代表する Generative AI (生成 AI) から Agentic AI (エージェント型 AI) への移行、つまり様々な業界のタスクを支援できる AI エージェントの可能性を示唆し、AI エージェントが様々な産業を牽引すると述べています。

AI エージェントの課題

複雑なパイプライン

AI エージェントはこれまでの AI では実現できなかった、様々な複雑なタスクを実行することが期待されているため、複數の大規模言語モデル (LLM) や VLM、PDF 等からの情報抽出、Web サーチ、高性能なベクトル データベースなど様々な機能を組み合わせる必要があります。そのため、プログラムが複雑になる傾向があり、AI エージェント活用の障壁となっています。

AI エージェントは、利用可能なツールとして、例として異なる種類の LLM や VLM 、PDF 等からの情報抽出、Web サーチ、高性能なベクトル データベースなどを開発者が與えると、自律的にこれらのツールを選択して実行します。これらのツールは、Web サーチなどの外部 API を呼び出したり、ライブラリを利用してデータを処理したりするプログラムです。多數のツールを組み合わせることは、より AI エージェントを強力なものにしますが、一方でプログラムをより複雑にします。ツールなどを入れ替え、チューニングしながら、AI エージェントを素早くテストしたい開発者にとっては、プログラミングにかける時間を短くしたいというニーズが常にあります。また、ツールにアクセスするためのライブラリやコンポーネントが揃っていない環境では、そのために必要な機能を開発者が都度作成することになるため、さらに多くの時間を要します。

機密情報の取り扱い

製造業をはじめとする産業では一般的なドメインに関しては SaaS 型の生成 AI アプリケーションの活用が進む一方で、本當に効率化したい日々の業務 (専門ドメイン) においては、企業の機密情報 (例として機密性の高い設計仕様や顧客情報など) の取り扱いに制限があり、思うように生成 AI の活用が進まないケースが見られます。

AI エージェントが複雑で高度なタスクを実行できるようになるにつれて、専門ドメインへの活用が積極的に検討されていますが、企業の機密情報の取り扱いに対応するためにも、オンプレミス環境でセキュアに AI エージェントを活用できる選択肢は重要です。

これらの課題に対処するためにも、オンプレミス環境で Low-code/No-code ツールを活用して AI エージェントを構築できる選択肢は、プログラミングの工數を大幅に削減しつつ、専門ドメインに AI エージェントを適用できる有望なアプローチです。

ここでマクニカの AI TRY NOW PROGRAM 環境に構築した DataStax 社の Langflow 上で再現できる NVIDIA AI Blueprints をご紹介します。

DataStax Langflow

DataStax の Langflow は、AI エージェントに多様なツールを組み込み迅速にテストするための最適なプラットフォームを提供します。クラウド環境とオンプレミス環境の両方で柔軟に利用可能であり、DataStax のホスティング サービスを用いることで信頼性とセキュリティの高いクラウド環境での管理が容易です。一方で、オープン ソース版はオンプレミス環境にも対応し、開発者が獨自のインフラでツールの入れ替えやチューニングを行いながら効率的に AI エージェントを開発できます。

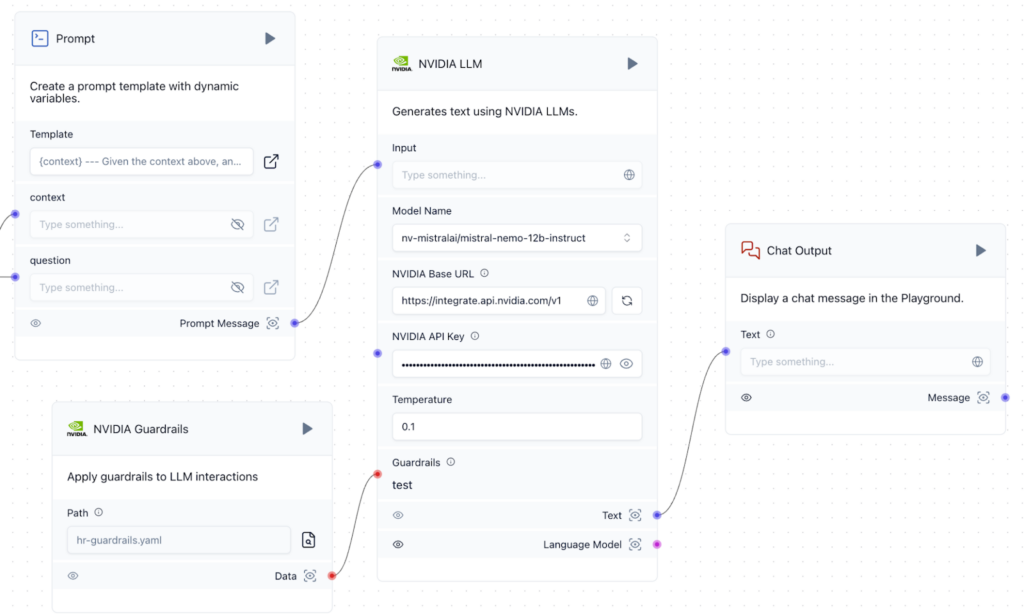

Langflow は、詳細なプログラミングを必要とせずに多様な AI エージェントの処理フローを構築できる Low-code/No-code 環境を提供します。これにより、開発者は時間を節約しながら複雑なツールの統合やチューニングを迅速に行うことができます。クラウド ホスティングを利用する場合、Langflow はDataStax の Astra DB クラウドのセキュリティ機能を活用し、安全な環境で API エンドポイントを提供し、外部の API やリソースとのシームレスな統合が可能です。

また、Langflow は多様なベクトル データベース、埋め込みモデル、LLM などをサポートしており、開発者は自身のプロジェクトの特定ニーズに応じた最適なツールを選ぶことができます。現時點で必要なライブラリやコンポーネントが揃っていなくとも、Langflow を導入することで、ツールを迅速に作成/統合し AI エージェントを強化することができます。Langflow のもう 1 つの強みはそのデプロイメントとインテグレーション機能です。Langflow を使用すれば、DataStax のデータベースや NVIDIA NIMを含むさまざまな生成 AI モデル、多様なツールを組み合わせた AI エージェントの迅速なデプロイが可能であり、API エンドポイントのホスティング機能を通じて外部アプリケーションとの連攜も容易です。

DataStax HCD (Hyper-Converged Database)

DataStax Hyper-Converged Database (HCD) は、Kubernetes 上で稼働するクラウドネイティブなデータ インフラストラクチャであり、Apache Cassandra をベースとした、高いスケーラビリティと信頼性を提供します。生成 AI アプリケーションのためのベクトル検索機能を搭載しており、迅速にプロビジョニングし、Python といった主要な言語で API で操作できるため、開発者はすぐにアプリケーション開発に取り組むことができます。HCD はクラウドおよびオンプレミスの両方に対応しており、マルチクラウドも可能です。金融、ヘルスケア、Eコマース、通信といった業界でリアルタイムデータ処理や AI の活用を支援します。さらに、暗號化や GDPR、SOC 2、HIPAA に対応したセキュリティとコンプライアンス機能も完備しています。Langflow から HCD を呼び出して LLM と接続することが可能で、RAG などの生成 AI アプリケーションを容易に構築できます。

NVIDIA AI Blueprints

NVIDIA AI Blueprints は生成 AI アプリケーション の開発と デプロイ を加速するために設計された カスタマイズ可能な リファレンス ワークフロー です。さまざまな ユース ケース に対応したワークフローが事前に用意されており、開発者は企業のユース ケース にあった blueprint を參照することで生成 AI アプリケーションの開発を加速させることが可能です。blueprint には、AI エージェント、NVIDIA アクセラレーション ライブラリや SDK、NVIDIA NIM マイクロサービスなどが含まれ、例として Multimodal PDF Data Extraction を使用した RAG パイプラインの blueprint は下図のようになっています。

この blueprint の再現にはこちらのノートブックにある Docker Compose を使用したコマンドを実行するか、図の Extraction Pipeline の実裝が含まれるリポジトリ NV-Injest と、既に開発者が用意している Retrieval Pipeline を組み合わせるなどの方法もありますが、Langflow に統合された NVIDIA NIM と NV-Injest のコンポーネントを活用することで GUI を通じて Low-code で再現することも可能です。

Langflow で再現する Multimodal PDF Data Extraction をマクニカの環境で検証

こちらの動畫では、まず図 3 に示す Extraction Pipeline を再現しています。NVIDIA Embedding NIM、NVIDIA-Ingest、ベクトル データベースとして HCD を配置し、それぞれを GUI から繋ぐことで、PDF からテキストだけでなく、表やチャート等を読み取ってデータベースに保存しています。その後、Retrieval Pipeline を Langflow 上で NIM や HCD、その他のコンポーネントを使用して再現しています。これにより、PDF の表やチャートを活用できるマルチモーダルな RAG の Chatbot を迅速に再現し、評価を加速することが可能です。また、マクニカではこれらを AI TRY NOW PROGRAM で上に構築し、評価と検証を行いました。

AI TRY NOW PROGRAM

マクニカが提供する AI TRY NOW PROGRAM は NVIDIA 開発環境上で最新の AI ソリューションを自社への導入前に検証できるサポート プログラムです。

最適なハードウェア構成でソフトウェアの検証をすることで、本番環境に近いパフォーマンス及び機能の KPI 測定ができ、導入の意思決定を加速することが期待できます。

マクニカでは、AI TRY NOW PROGRAM 環境上で NVIDIA NIM、NeMo、Blueprints、DataStax Langflow など様々なソフトウェアの動作検証を行っており、本番導入を見據えた環境で NVIDIA プラットフォームの検討を進めることが可能です。

まとめ

Langflow に統合されている DataStax のデータベース、NVIDIA NIM や NV-Injest、その他の多様なツールを基に開発者は AI エージェント ワークフローを少ない労力で構築することが可能です。また、これらを導入検討していく際にはマクニカの AI TRY NOW PROGRAM を試すことができます。