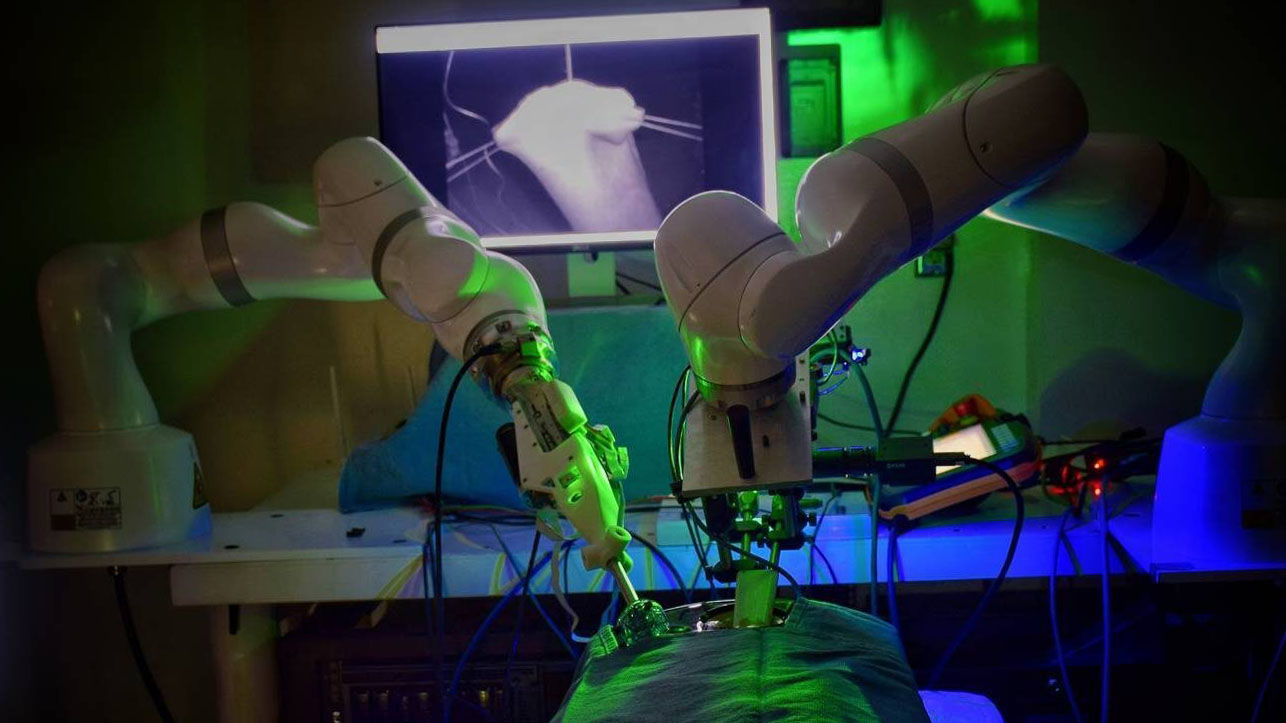

醫療分野では初めて、外科醫の手を介さずにロボットが腹腔鏡手術を行うことに成功しました。Science Robotics 誌に掲載されたこの研究は、豚の軟組織でこの困難な作業を完了したスマート組織自律型ロボット (STAR) の強化版の設計を概説しています。この成果は、完全自動化されたロボット手術に向けたマイルストーンとなるものです。

「今回の成果は、外科手術の中でも最も複雑で繊細な作業のひとつである、腸の両端を再びつなぐ作業を自動化できることを示しています。STAR は 4 匹の動物でこの手術を行いましたが、人間が同じ手術を行うよりも格段に良い結果が得られました」と、ジョンズ?ホプキンス大學ホワイティング工學部の機械工學助教授で上級著者の Axel Krieger 氏はプレスリリースで述べています。

腹腔鏡下手術では、外科醫は小さな切開創とカメラを使って、腹部や骨盤の中で手術を行う。血管や腸など、2本の管狀の構造物をつなぐ吻合 (ふんごう) は、腹腔鏡下で行われることが多いです。低侵襲である反面、縫合の不備による漏れが発生した場合、患者さんに重大な合併癥をもたらす可能性があります。

自律型ロボット手術は、醫療の効率性、安全性、信頼性を向上させる可能性を秘めています。しかし、この研究によると、自律型吻合は、複雑な畫像処理、組織追跡、手術計畫に関して課題も提起しています。これらの処置は手術中に問題が発生した場合、迅速な適応を必要とすることが多いということです。

今回の STAR は、2016 年に開発された豚の腸を縫合できるモデルを改良したものですが、人手を必要とし、切開創も大きくなってしまいます。

高度なロボット精度と縫合ツール、3D 畫像システム、機械學習ベースの追跡アルゴリズムにより、最新のSTARはリアルタイムで手術計畫を調整することができます。

「機械學習、コンピューター ビジョン、高度な制御技術を開発し、患者の呼吸に応じた標的組織の動きを追跡し、異なる縫合ステップ間の組織の変形を検出し、運動制約下でロボットを操作しました」と、研究者はこの研究レポートの中で書いています。

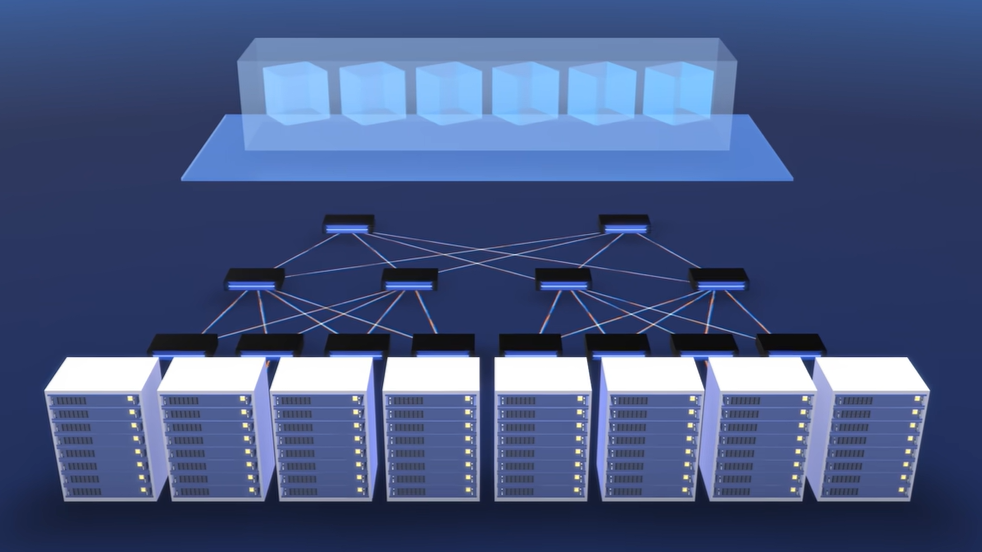

畳み込みニューラル ネットワーク (CNN) に基づく機械學習アルゴリズムは、組織の動きを予測し、縫合計畫をガイドします。研究者らは、吻合手術の動作プロファイルの 9,294 の例を用いて CNN を訓練し、手術中の呼吸パターンや他の組織の動きに基づいて組織の動きを學習させました。

ロボットがカメラと同期してスキャンし、組織が靜止している間に縫合計畫を作成します。強化されたコンピューター ビジョンと CNN ベースのランドマーク検出アルゴリズムを用いて、STAR は隣接する組織を接続するための 2 つの初期縫合計畫を作成する。オペレーターがプランを選択すると、ロボットは組織に縫合糸を適用し、組織の変形を再撮影します。

手術計畫に対して組織の位置が 3mm 以上変化した場合、オペレーターに通知し、新たな縫合計畫/承認ステップを開始させる。このプロセスを縫合ごとに繰り返すのです。

Krieger 氏によると、CNN の學習と実行には NVIDIA GeForce GTX GPU が使われ、4 つの畳み込み層、3 つの密層、組織の動きを追跡する 2 つの出力が含まれていました。カスケード型 U-Net アーキテクチャを用いたランドマーク検出アルゴリズムの訓練とテストは、 NVIDIA T4 GPU を用いて行われています。

研究者らは、針の配置の修正、縫合糸の間隔、縫合糸の噛み合わせの大きさ、完了時間、ルーメン開存性、リーク圧などの吻合の質を調査しました。その結果、自律型 STAR は熟練外科醫とロボット支援手術の両方の一貫性と精度を上回りました。

「STAR が特別なのは、人間の介入を最小限に抑えながら、軟組織での手術計畫を立て、適応させ、実行する初めてのロボットシステムであることです」と Krieger 氏は述べています。

Science Robotics 誌の研究內容を読む >>

続きを読む >>

翻訳に関する免責事項

この記事は、「Autonomous Robot Improves Surgical Precision Using AI」の抄訳で、お客様の利便性のために機械翻訳によって翻訳されたものです。NVIDIA では、翻訳の正確さを期すために注意払っておりますが、翻訳の正確性については保証いたしません。翻訳された記事の內容の正確性に関して疑問が生じた場合は、原典である英語の記事を參照してください。

?