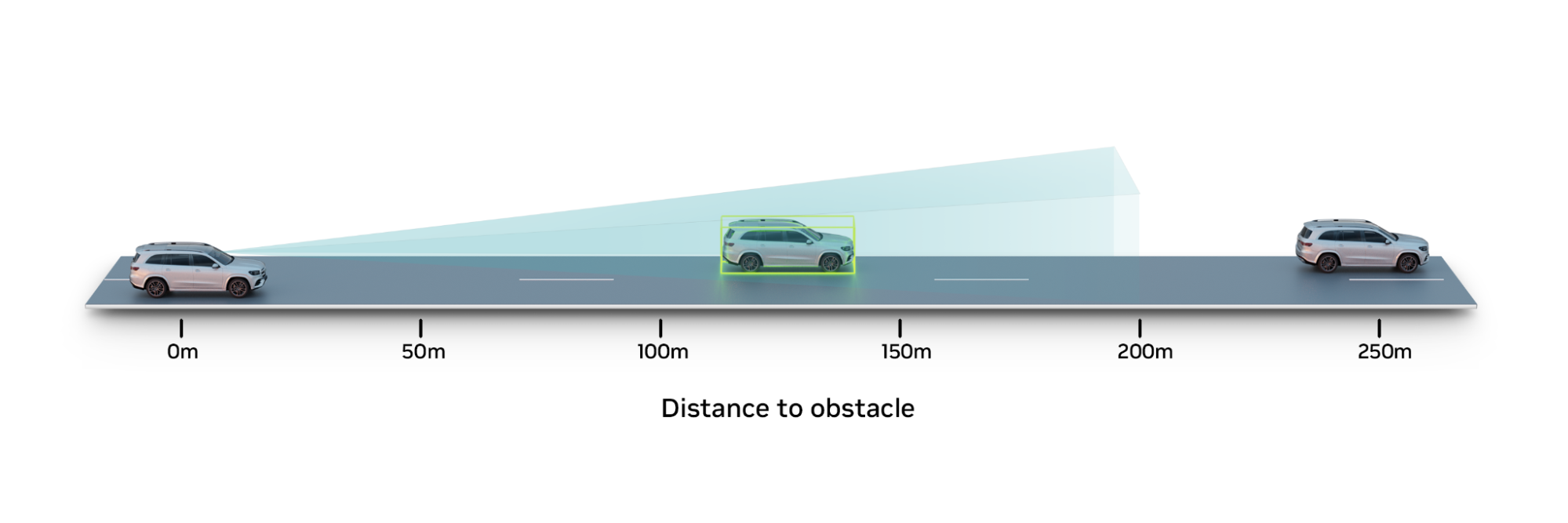

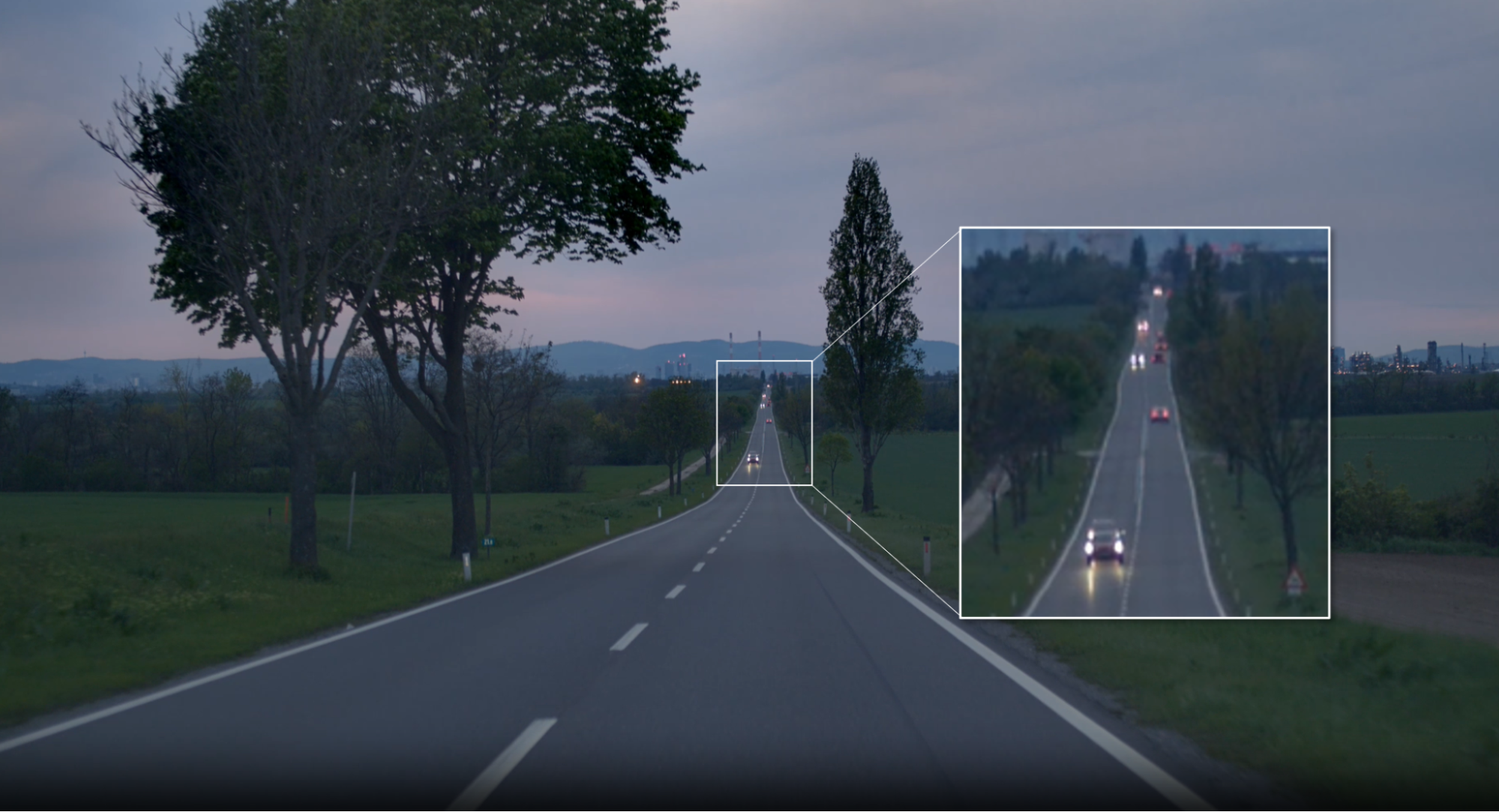

檢測遠場物體,如 100 米以外的車輛,是自動駕駛系統在高速公路上安全操作的基礎

在這樣的高速環境中,每一秒都很重要。因此,如果在以 70 英里/小時的速度行駛時,自動駕駛汽車( AV )的感知范圍可以從 100 米增加到 200 米,那么車輛有更多的時間做出反應。

然而,對于通常部署在量產乘用車中的基于攝像頭的感知系統來說,擴展這一范圍尤其具有挑戰性。訓練用于遠場物體檢測的相機感知系統需要收集大量的相機數據以及地面實況( GT )標簽,例如 3D 邊界框和距離。

對于超過 200 米的物體來說,提取這些 GT 數據變得更加困難。物體離得越遠,在圖像中就越小,最終只有幾個像素寬。通常,像激光雷達這樣的傳感器與聚合和自動標記技術一起使用來提取 3D 和距離信息,但這些數據在激光雷達的工作范圍之外變得稀疏和嘈雜。

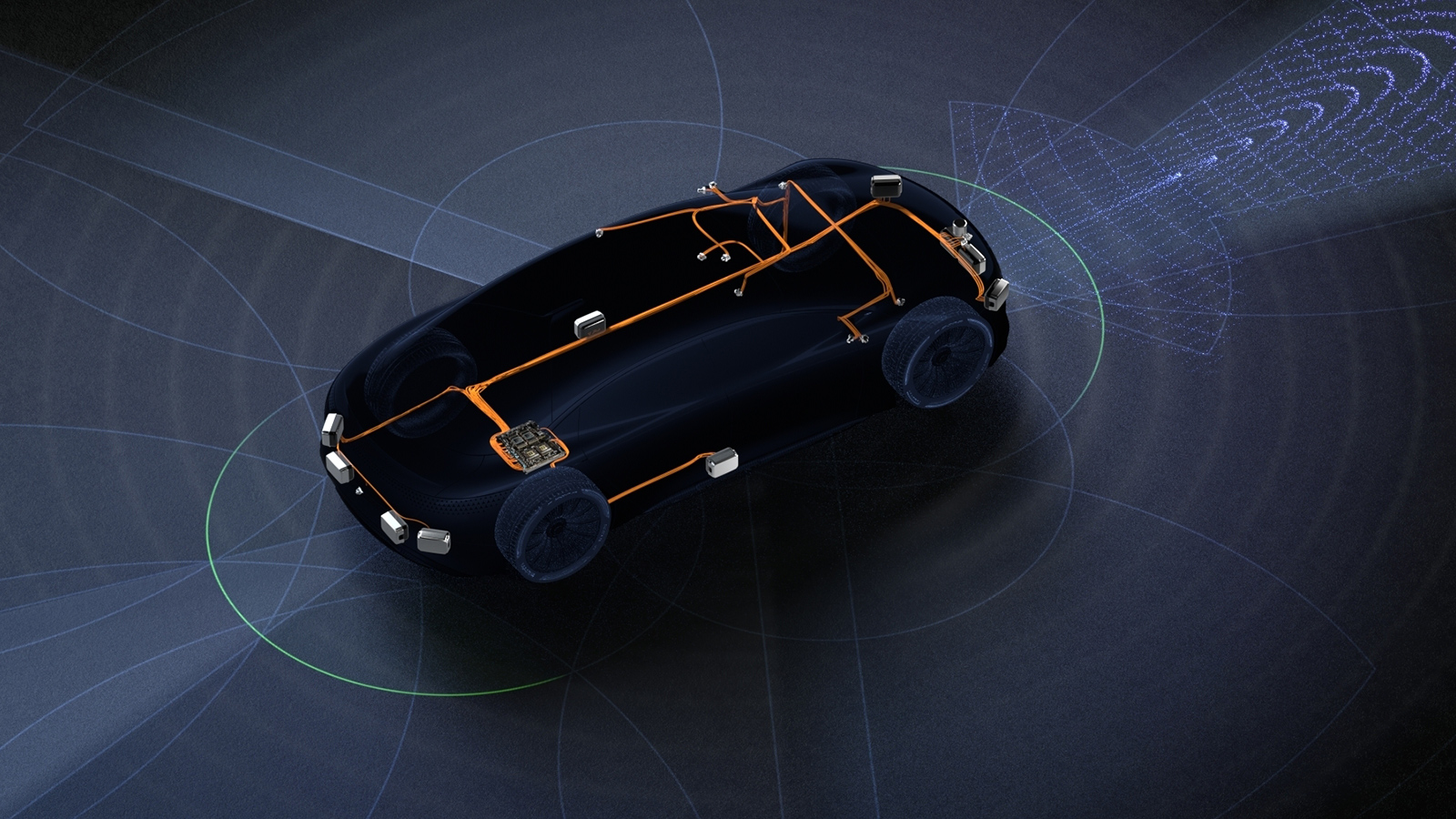

這個NVIDIA DRIVEAV 團隊需要在開發過程中解決這一確切的挑戰。為此,我們在NVIDIA DRIVE Sim,利用NVIDIA Omniverse Replicator.

NVIDIA DRIVE Sim 是一款基于 Omniverse 的 AV 模擬器,包括經過高保真度傳感器模擬驗證的基于物理的傳感器模型。有關更多詳細信息,請參閱Validating NVIDIA DRIVE Sim Camera Models.

NVIDIA DRIVE Sim 能夠以像素級的精度查詢模擬場景中每個物體的位置,包括以任何相機分辨率放置在距離自我車輛 400 米或 500 米處的物體

當車輛位置信息與基于物理的合成相機數據相結合時,可以生成用于感知的必要的 3D 和距離 GT 標簽

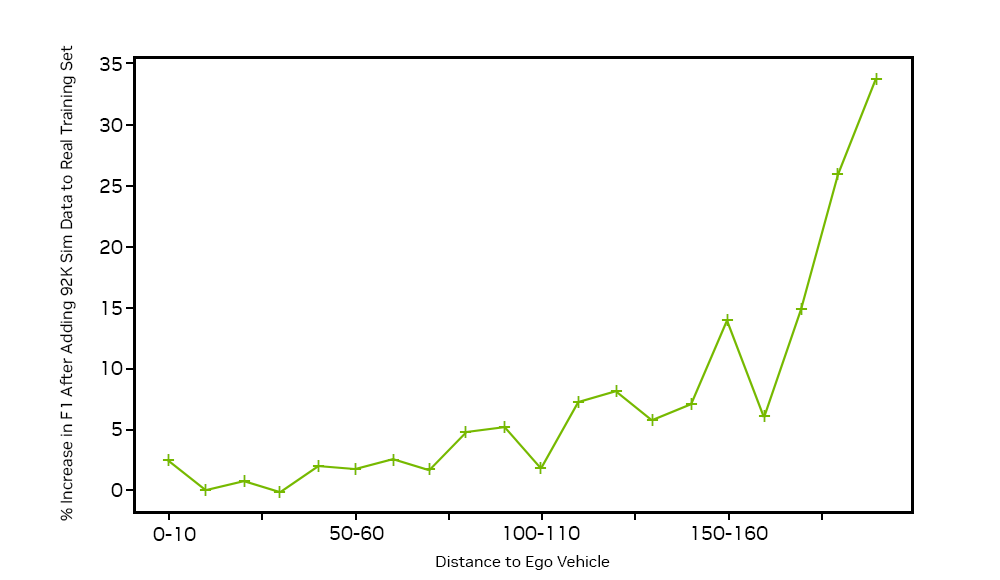

通過將這些合成 GT 數據添加到我們現有的真實數據集中,我們能夠訓練網絡來檢測遠距離的汽車,并在 190 米至 200 米的距離內實現 33% 的 F1 成績提高。

用于遠場物體的合成 GT 數據生成

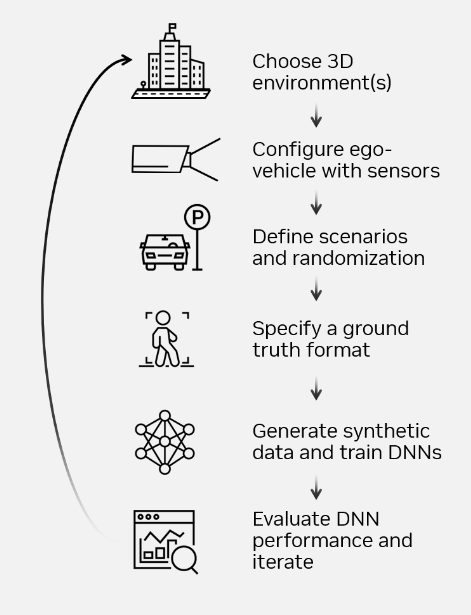

為了解決精確標記的遠場數據的稀缺性,我們的目標是生成一個由近 100 K 長距離物體圖像組成的合成數據集,以增強現有的真實數據集。圖 3 顯示了使用 Omniverse Replicator 在 NVIDIA DRIVE Sim 中生成這些數據集的過程,從選擇 3D 環境到評估深度神經網絡( DNN )性能。

在選擇了解決高速公路用例的 3D 環境后,我們配置了一輛配備必要攝像頭傳感器的 ego 車輛。

NVIDIA DRIVE Sim 利用基于 Omniverse Replicator 框架構建的域隨機化 API ,以編程方式更改 3D 資產的外觀、位置和運動。通過使用ASAM OpenDRIVE繪制 API 地圖時,我們將車輛和障礙物放置在 100 米至 350 米的遠場距離處,并以上下文方式放置在遠處。

NVIDIA DRIVE Sim 動作系統能夠模擬各種引入閉塞的具有挑戰性的情況,如車道變更或近距離切入。這為現實世界中難以遇到的場景提供了關鍵數據

在數據生成之前的最后一步,我們利用 Omniverse Replicator 中的 GT 編寫器生成必要的 標簽,包括三維邊界框、速度、語義標簽和對象 ID 。

利用合成相機數據提高相機感知性能

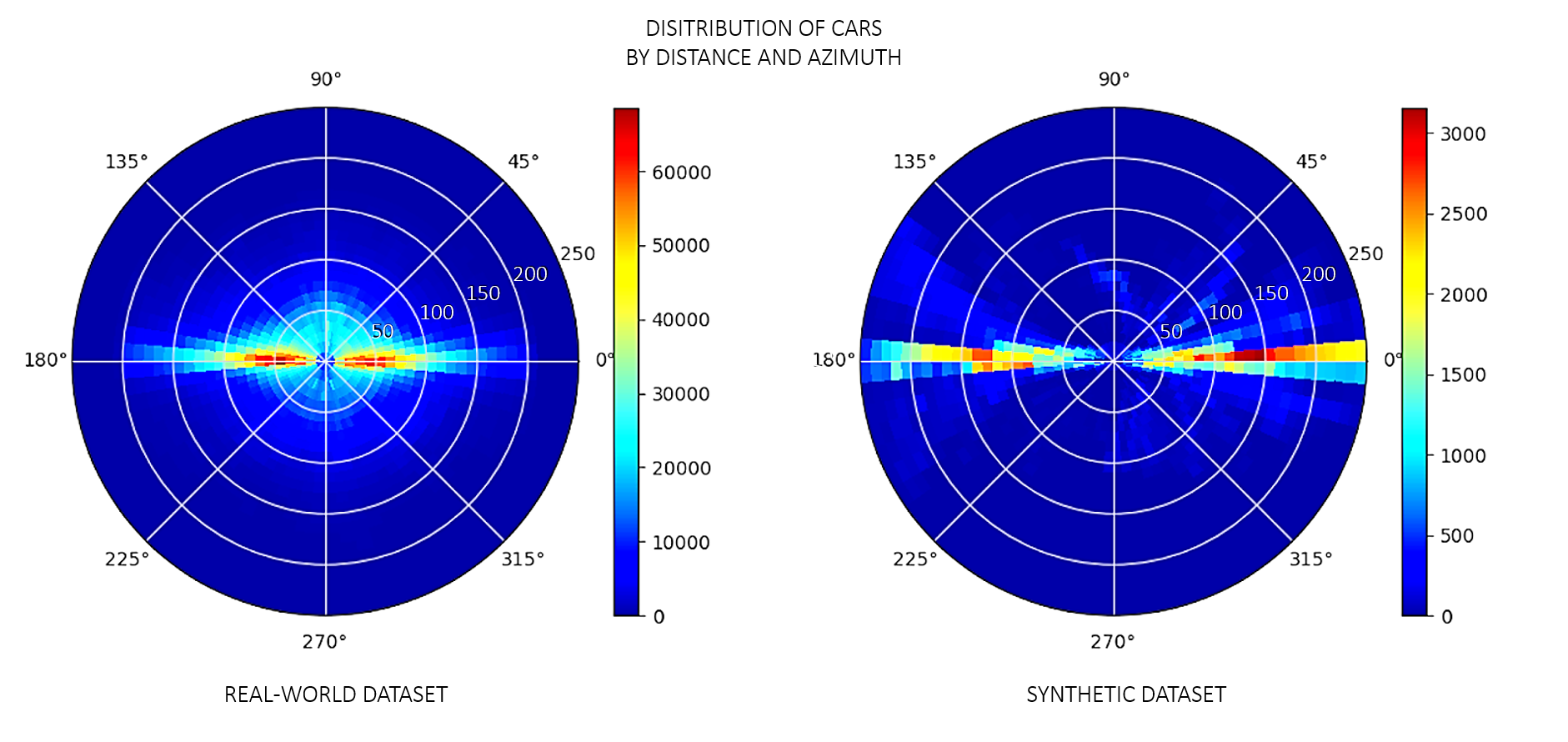

對于該用例,真實訓練數據集由 100 多萬張圖像組成,其中包含 200 米以下高速公路場景中車輛的 GT 標簽。如圖 4 左側所示,這些真實圖像中的汽車分布在距離數據采集車輛不到 100 米的地方達到峰值。對于距離更遠的物體, GT 標簽稀疏,不足以增強感知。

在這種情況下,我們生成了約 92 K 的合成圖像,其中約 371 K 個汽車實例和 GT 標簽集中在高達 350 米的遠程車輛分布上。合成數據集中的汽車分布更傾向于 150 米及更遠的距離。通過將~ 92K 的合成圖像添加到該真實數據集中,我們將所需的標記遠場對象引入到訓練分布中

在組合數據集上訓練感知算法后,我們將網絡與汽車分布高達 200 米的真實數據集進行了測試。通過距離提高感知性能的 KPI 顯示 F1 分數提高了 33% ,這是對 190 米至 200 米汽車數據集上模型準確性的衡量

總結

合成數據正在推動 AV 開發的重大范式轉變,解鎖以前不可能的新用例。使用 NVIDIA DRIVE Sim 和 NVIDIA Omniverse Replicator ,您可以在虛擬試驗場中制作新傳感器的原型,評估新的地面實況類型和 AV 感知算法,并模擬罕見和不良事件,所有這些都只需現實世界所需時間和成本的一小部分。

合成數據集為 AV 感知提供的豐富可能性不斷發展。要查看我們的工作流程并了解更多信息,請觀看 NVIDIA GTC DRIVE 開發者日會議,How to Generate Synthetic Data with NVIDIA DRIVE Replicator.

?