本文最初發布于 2025 年 1 月,但已根據新信息進行了廣泛的修改。

通用人形機器人 旨在快速適應現有的以人為中心的城市和工業工作空間,處理繁瑣、重復性或對體力要求較高的任務。這些移動機器人在以人為中心的環境中自然而然地表現出色,使它們從工廠車間到醫療健康設施的價值越來越高。

模仿學習是 機器人學習 的一個子集,使人形機器人能夠通過觀察和模仿人類專家的演示來獲得新技能,這些演示可以來自遠程操作演示中的人類真實視頻,也可以來自模擬數據。模仿學習使用已標記的數據集,有利于在難以編程定義的不同環境中教授機器人復雜動作。

雖然錄制演示可能比指定獎勵策略更簡單,但創建完美的演示可能具有挑戰性,并且機器人可能會在不可預見的場景中遇到困難。在現實世界中收集大量高質量數據集繁瑣、耗時且成本高昂。但是,物理屬性準確的模擬生成的 合成數據 可以加速數據收集過程。

用于合成操作動作生成的 NVIDIA Isaac GR00T 藍圖是基于 NVIDIA Omniverse 和 NVIDIA Cosmos 構建的參考工作流 。它從少量的人類演示中創建了大量的合成運動軌跡,用于機器人操作。

借助該藍圖的首批可用組件,NVIDIA 僅在 11 小時內即可生成 780K 個合成軌跡,相當于 6.5K 個小時或連續 9 個月的人類演示數據。然后,將合成數據與真實數據相結合,與僅使用真實數據相比,NVIDIA 將 GR00T N1 的性能提高了 40%。

視頻 1。借助 NVIDIA Isaac GR00T 簡化數據采集

在本文中,我們將介紹如何使用 空間計算 設備(例如 Apple Vision Pro)或其他捕獲設備(例如 space mouse)進入模擬機器人的 數字孿生 ,并通過遠程操作模擬機器人來記錄運動演示。然后,使用這些記錄生成更大的物理屬性準確的合成運動軌跡集。該藍圖通過生成指數級龐大、逼真且多樣化的訓練數據集,進一步增強了數據集。然后,我們使用這些數據對機器人策略模型進行后期訓練。

Blueprint 概述

工作流程的關鍵組件包括以下內容:

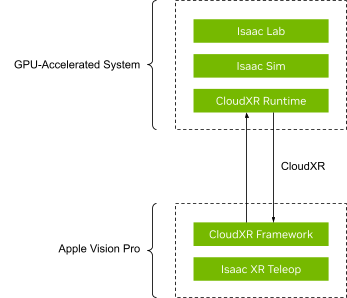

- GR00T-Teleop:即將推出,但您現在可以使用藍圖中提供的樣本數據。 NVIDIA CloudXR Runtime:將 Isaac Lab 模擬串流到 Apple Vision Pro,并接收用于人形機器人遠程操作的控制數據。 適用于 Apple Vision Pro 的 Isaac XR Teleop 示例應用:使用戶能夠與從 CloudXR Runtime 流式傳輸的 Isaac Lab 模擬進行沉浸式交互,并發送回用于人形機器人遠程操作的控制數據。

- GR00T-Mimic:使用錄制的演示作為輸入,在 Isaac Lab 中生成額外的合成運動軌跡。 此藍圖的第一版僅用于單臂操作。即將支持雙手動人形機器人操作。要記錄您自己的動作,請使用空格鼠標控件記錄動作。有關更多信息,請參閱 生成其他演示 。

- GR00T-Gen:通過隨機化場景中的背景、照明和其他變量來增加多樣性,并 通過 NVIDIA Cosmos Transfer 增強生成的圖像。

- Isaac Lab:使用統一的開源機器人學習框架訓練機器人策略。 Isaac Lab 基于 NVIDIA Isaac Sim 構建。

工作流從數據采集開始,使用 Apple Vision Pro 等高保真設備在模擬環境中捕捉人類動作。Apple Vision Pro 將手部追蹤數據串流到 Isaac Lab 等模擬平臺,該平臺可同時將機器人環境的沉浸式視圖串流回設備。這種設置實現了機器人的直觀交互式控制,有助于收集高質量的遠程操作數據。

Isaac Lab 中的機器人仿真將串流到 Apple Vision Pro,使您能夠可視化機器人的環境。通過移動雙手,您可以直觀地控制機器人執行各種任務。這種設置有助于實現沉浸式交互式遠程操作體驗。

使用 GR00T-Mimic 生成合成操作運動軌跡

收集數據后,下一步是生成合成軌跡。Isaac GR00T-Mimic 用于從一小部分人類演示中推斷,創建大量合成運動軌跡。

此過程包括標注演示中的關鍵點,并使用插值法確保合成軌跡平滑且符合上下文。然后,對生成的數據進行評估和改進,以滿足訓練所需的標準。

在本示例中,我們成功生成了 1K 合成軌跡。

增強和生成大型數據和多樣化數據集

為了縮小仿真與現實之間的差距,關鍵是將合成生成的圖像增強到必要的逼真度,并通過隨機化照明、顏色和背景等各種參數來增加多樣性。

通常,這個過程需要構建逼真的 3D 場景和物體,并且需要大量的時間和專業知識。借助 Cosmos Transfer (WFMs) ,只需簡單的文本提示,即可將此過程從幾小時大幅加速到幾分鐘。

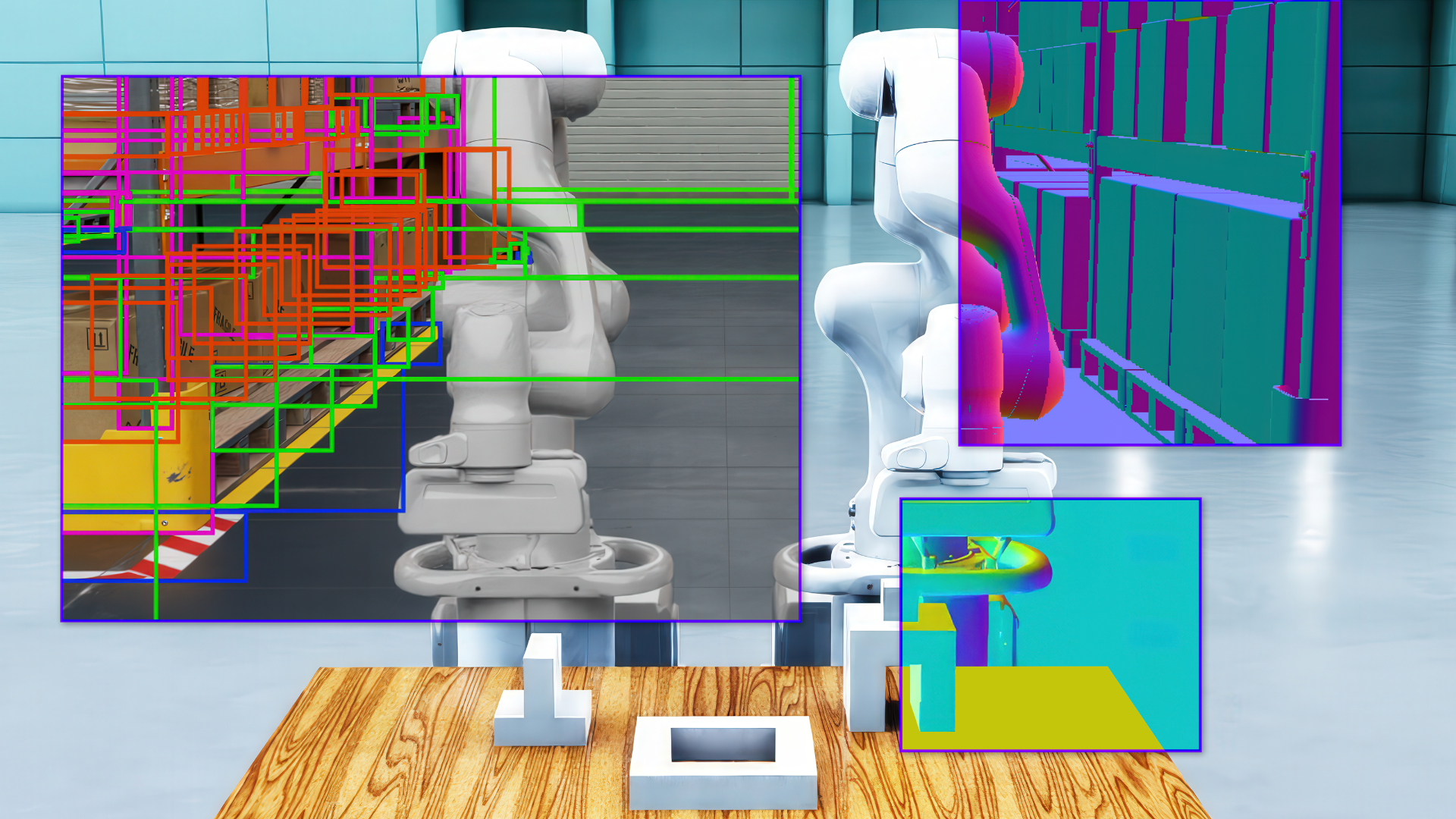

圖 5 和圖 6 展示了通過 NVIDIA Cosmos Transfer WFM 傳遞合成生成的圖像可實現的逼真度示例。

在 Isaac Lab 中使用模仿學習進行后訓練

最后,使用合成數據集,使用模仿學習技術來訓練機器人。在此階段,訓練 Robomimic 套件中的遞歸高斯混合模型(GMM)等策略來模擬合成數據中演示的動作。訓練在 Isaac Lab 等模擬環境中進行,并通過多項試驗評估訓練好的策略的性能。

為了展示如何使用這些數據,我們訓練了一個配備機械手的 Franka 機器人在 Isaac Lab 中執行堆疊任務。我們將 Behavioral Cloning 與 Robomimic 套件 中的遞歸 GMM 策略結合使用。該策略使用兩個隱藏維度為 400 的長短期記憶(LSTM)層。

網絡輸入包括機器人的終端執行器姿態、抓手狀態和相對物體姿態,而輸出是用于在 Isaac Lab 環境中步進機器人的增量姿態動作。

借助由 1K 成功演示和 2K 迭代組成的數據集,我們實現了約 50 次迭代/ 秒的訓練速度 (相當于在 NVIDIA RTX 4090 GPU 上訓練時間約為 0.5 小時) 。經過平均 50 多次試驗,經過訓練的策略在堆棧任務中的成功率達到了 84%。

工作流程優勢

此方法的主要優勢在于在數據收集過程中節省了時間,從堆疊立方體到線程針等各種操作任務的成功率即可證明這一點,例如在使用 GPU 和 cuOpt 等技術時,成功率顯著提高。

傳統上,經過適當訓練的人工操作員記錄一次高質量演示大約需要一分鐘,但由于需要大量的人工努力和可能出現的錯誤,因此難以擴展。相比之下,這種新方法通過結合幾次人類演示和合成數據實現了類似的成功率,將數據采集時間從幾小時縮短到幾分鐘。

加入 NVIDIA Cosmos 后,您可以增強合成圖像,以實現所需的逼真度,僅使用文本提示即可有效縮小模擬與現實之間的差距。這種方法顯著簡化了數據收集過程,使您能夠生成多樣化的大型數據集,同時保持或提高生成的機器人策略的質量。

采用該藍圖的開發者

Agibot、Mentee Robotics、 UCR 和 X-Humanoid 等人形機器人開發者已將該藍圖的組件集成到其人形機器人開發流程中。

Field AI、Lab0、Miso Robotics、RIVR 和 Sanctuary AI 等其他公司也在利用 Isaac 模擬框架。他們正在利用它開發機器人大腦和軟件棧,以及測試和驗證物理機器人。

開始使用

在本文中,我們討論了如何收集、生成和增強使用 NVIDIA Isaac GR00T 合成操作動作生成藍圖訓練單臂操作器所需的數據。

- 在 build.nvidia.com 上體驗用于合成操縱運動生成的 NVIDIA Isaac GR00T 藍圖

- 從/NVIDIA-Omniverse-blueprints GitHub 存儲庫下載藍圖,并在您選擇的基礎架構上進行部署

此藍圖的第一版僅用于單臂操作。我們即將推出對雙手動人形機器人操作的支持。

如需了解有關 NVIDIA Isaac GR00T 的更多詳細信息,請觀看 NVIDIA 首席執行官 Jensen Huang 先生的 GTC 主題演講 以及 包括“構建人形機器人簡介”在內的 GTC 主要會議 。

訂閱我們的 時事通訊 ,并在 YouTube 、 Discord 和 開發者論壇 上關注 NVIDIA Robotics ,及時了解 最新動態 。

?

?