Speech AI Summit 是一個年度會議,匯集了人工智能和語音技術領域的專家,討論最新的行業趨勢和進步。這個會議的錄音講話,由 Coqui.ai 主持,總結了 2022 年峰會的零點擊多說話者 TTS 系統的概述。

用秒音頻合成語音

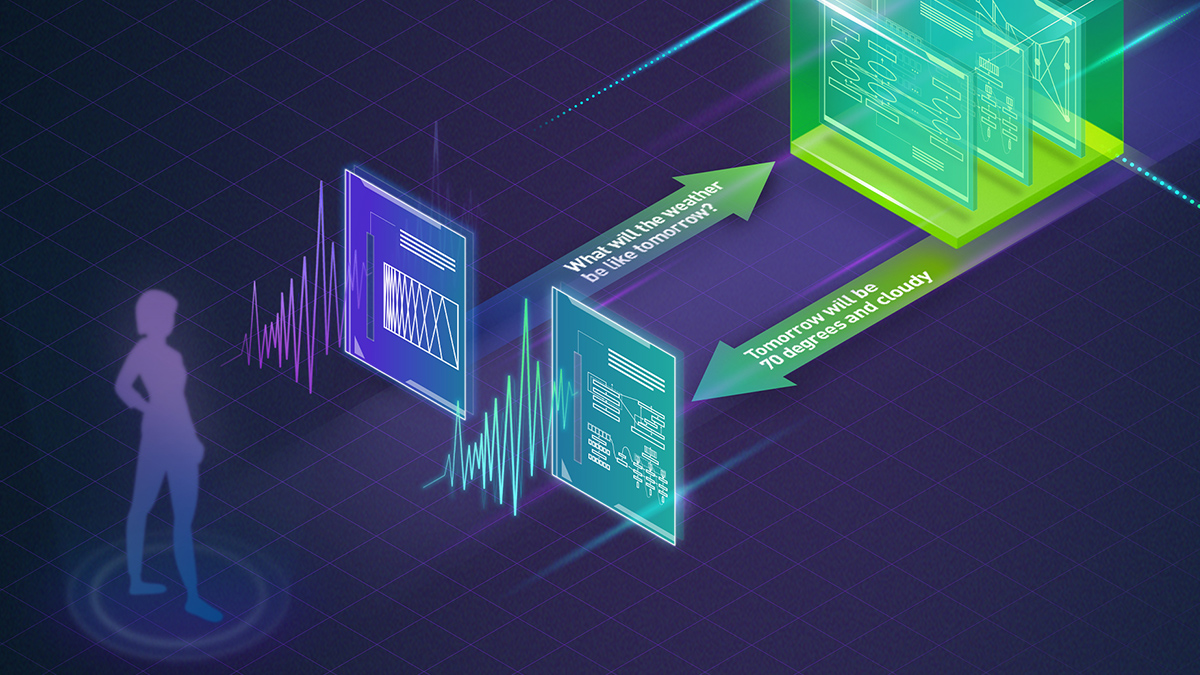

近年來,文本到語音( TTS )系統憑借深度學習方法取得了顯著進步。這些進步推動了旨在僅用幾秒鐘的語音將語音合成目標說話者的語音的研究。這種方法稱為零樣本多揚聲器 TTSCoqui . ai 會議探討了這種方法背后的時間表和最先進的技術。

以下是會議的一些要點:

- YourTTS 在英語方面取得了最先進的性能,并證明了使用單揚聲器數據集在目標語言中執行零樣本多揚聲器 TTS 的可行性。這為以低資源語言(如土著語言)開發這些系統開辟了可能性。想要了解更多信息,請訪問 YourTTS:走向零嘗試多揚聲器 TTS 和零嘗試語音轉換,讓每個人都可以使用。

- 揚聲器驗證系統的進步可以提高零樣本多揚聲器 TTS 系統的性能。

- 零樣本多揚聲器 TTS 可用于生成新的人工語音。這是通過對新的揚聲器嵌入進行采樣來實現的。新的揚聲器嵌入可以是完全隨機的向量或不同揚聲器嵌入之間的插值。例如,您可以在不進行版權保護的情況下生成聲音。

零樣本多揚聲器 TTS 系統的熱門問答

你能創造全新的聲音嗎?考慮過一分鐘的微調對零樣本有好處嗎?培訓 TTS 模型的硬件要求是什么? Edresson Casanova 深入探討了開發零樣本多揚聲器 TTS 系統的首要問題。

如何衡量文本到語音的質量?

一般來說,TTS 系統的質量和自然度可以通過平均意見得分(MOS)來衡量。使用這個指標,人類評估者聽音頻并給出一到五分的分數,一分表示質量差,五分表示質量好。

在零樣本多揚聲器 TTS 系統中,還必須使用 相似性 MOS 來測量揚聲器相似性。此外,還可以使用揚聲器編碼器來計算 揚聲器編碼器余弦相似性(SECS),以提取兩個音頻樣本的揚聲器嵌入,并計算這些嵌入之間的余弦相似性。

研究人員最近發表了論文,探索使用人工神經網絡來預測 MOS 。目前,這些系統的通用性還不夠好,尤其是對于新的記錄條件,例如不同的麥克風或噪聲環境。

語音到文本系統可以用來測量文本到語音系統的質量嗎?

語音轉文本(STT)系統可用于檢查 TTS 模型的發音是否正確,但在文獻中使用不多。STT 模型的評估僅涵蓋語音,而不涵蓋語音本身的質量方面。

與一分鐘微調相比,零樣本的好處是什么?

零樣本可以很好地工作,但并不總是如此。在一些錄音中,條件和聲音與訓練中看到的太不一樣了,從而導致零樣本可能會失敗,并產生與目標說話人的聲音不同的聲音。在這種情況下,可以使用一分鐘的微調。這篇 YourTTS 論文顯示,該模型可以很好地學習語音,即使是對于模型具有糟糕的零樣本的語音。

揚聲器編碼器的體系結構有多重要?你建議單獨訓練揚聲器編碼器還是與聲譜圖生成器一起訓練?

揚聲器編碼器是決定零樣本多揚聲器 TTS 模型最終質量的重要部件之一。如果沒有良好的揚聲器嵌入,該模型就無法克隆新的聲音。 YourTS 模型上使用的揚聲器編碼器在數千個揚聲器上分別進行了預訓練,并在訓練過程中保持凍結。

一些論文,如Attentron: Few-Shot Text-to-Speech Utilizing Attention-Based Variable-Length Embedding,表明將類似揚聲器編碼器的模塊與 TTS 模型一起訓練可以產生良好的結果。根據我的經驗,這取決于訓練中有多少演講者。如果沒有足夠的揚聲器多樣性,該模型很容易過擬合,并且不能很好地處理訓練中沒有出現的揚聲器或錄音條件。

是否可以插入揚聲器編碼器表示,以創建未知聲音作為已知聲音的混合?

這是可能的。它還可以通過隨機嵌入揚聲器來生成新的人工語音。盡管 YourTTS colab demos 不涵蓋此內容,但 SC-GlowTTS colab demo 展示了如何生成全新人工語音的示例。

模型是基于音素還是基于字符進行訓練?

YourTS 是基于角色的。然而,例如, Sc-GlowTTS 是基于音素的。在 YourTS 上,我們決定使用字符而不是音素來訓練它,因為該模型的目標是用于通常沒有良好音素化器的低資源語言。

訓練領先的文本到語音模型需要多少數據中心計算?

YourTS 使用了一個NVIDIA V100 32GB GPU,批量大小為 64。但是,也可以使用較少 VRAM 的 GPU,以較小的批量對其進行訓練。我從未嘗試過 VRAM 較少的 GPU,但我知道一些 Coqui TTS 貢獻者已經使用具有 11GB VRAM 的 GPU 對 YourTS 模型進行了微調。

在計算說話人嵌入時,從嵌入提取中排除某些片段(如無聲、清音或塞音)有幫助嗎?

盡管說話人編碼器應該學會如何忽略沉默,只關注語音,但在數據集預處理步驟中,我們消除了開始和結束的長時間沉默,以避免模型訓練過程中出現問題。然后,我們消除了長時間的沉默。然而,我們不刪除清音或塞音音位段。

表達性語言可以實現零樣本文本到語音轉換嗎?

這是可以實現的。在 Coqui.ai,我們已經開發出一種模型,可以實現零樣本多揚聲器 TTS,并在五種不同的情感中生成富有表現力的語音。此模型可通過 Coqui Studio 獲得。

更多資源

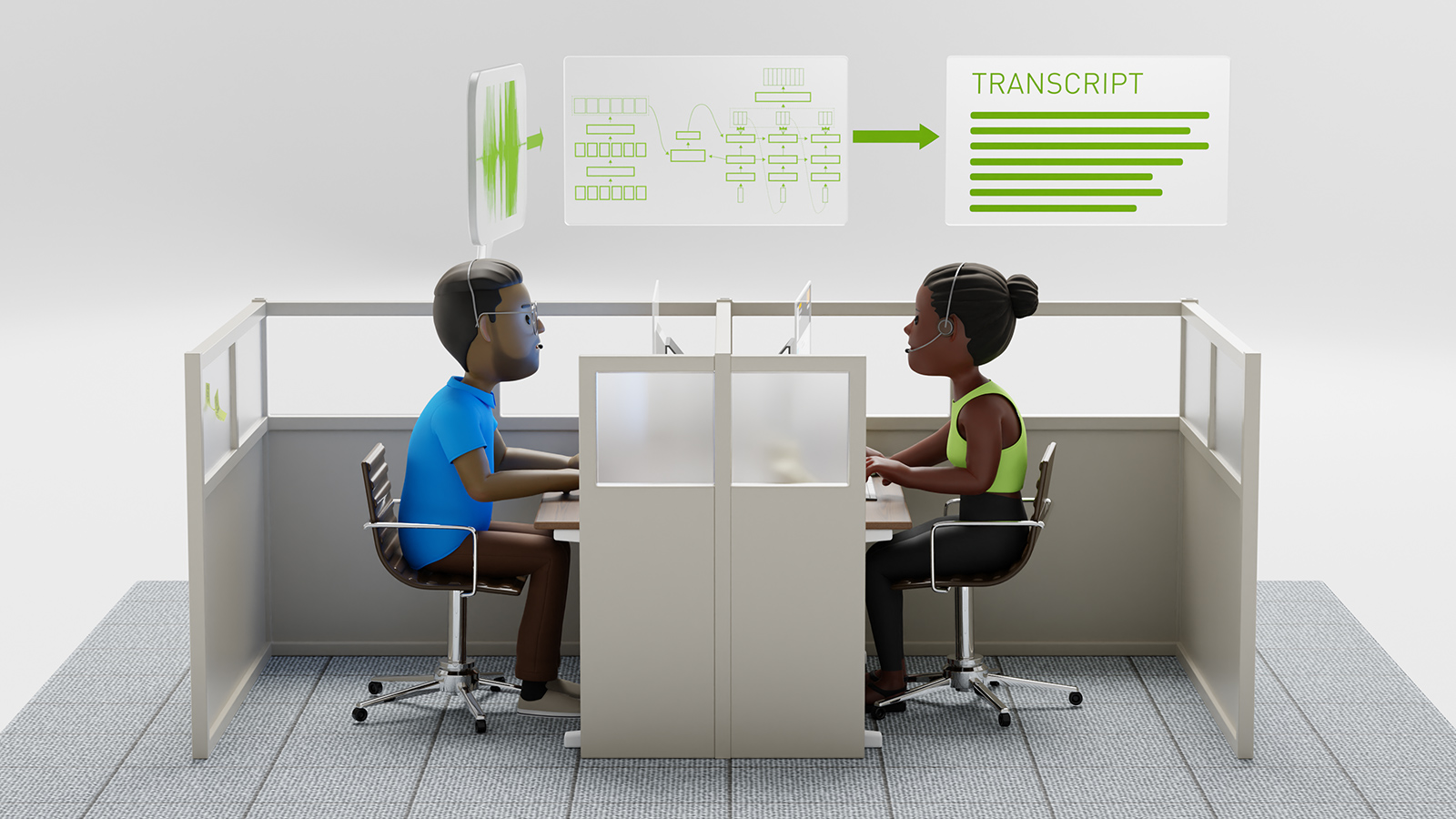

從微調模型到生成自定義語音,語音 AI 技術幫助組織在全球范圍內處理復雜的對話。查看以下資源,了解您的組織如何將語音人工智能集成到核心業務中。

- 想要深入了解日益增長的語音人工智能領域,可以通過免費電子書 《語音人工智能入門》 獲取更多信息。

- 探索如何使用免費電子書為您的應用程序構建和部署實時語音 AI 管道,《構建語音 AI 應用程序》。

- 了解如何通過 NVIDIA 深度學習學院的自主學習課程定制語音識別管道,開始使用高精度定制 ASR 語音 AI。

?