快速的數字化轉型導致整個企業生成的敏感數據激增。這些數據必須在本地、云中的數據中心中存儲和處理,或者在邊緣生成敏感和個人身份信息( PII )的活動示例包括信用卡交易、醫學成像或其他診斷測試、保險索賠和貸款申請。

這些豐富的數據為企業提供了一個機會,可以提取可操作的見解,釋放新的收入來源,并改善客戶體驗。利用人工智能的力量可以在當今數據驅動的商業環境中獲得競爭優勢。

然而,全球數據保護和隱私法的復雜性和不斷演變的性質可能會對尋求從人工智能中獲得價值的組織構成重大障礙:

- 歐洲通用數據保護條例( GDPR )

- 美國的健康保險便攜性和責任法案( HIPAA )和 Gramm-Leach-Bliley 法案( GLBA )

醫療保健、金融服務和公共部門的客戶必須遵守多種監管框架,并面臨因數據泄露而遭受嚴重財務損失的風險。

除了數據,人工智能模型本身也是寶貴的知識產權。它們是模型所有者在構建、培訓和優化方面投入大量資源的結果。如果在使用中沒有得到充分保護,人工智能模型將面臨暴露敏感客戶數據、被操縱或被逆向工程的風險。這可能導致錯誤的結果、知識產權的損失、客戶信任的侵蝕以及潛在的法律后果。

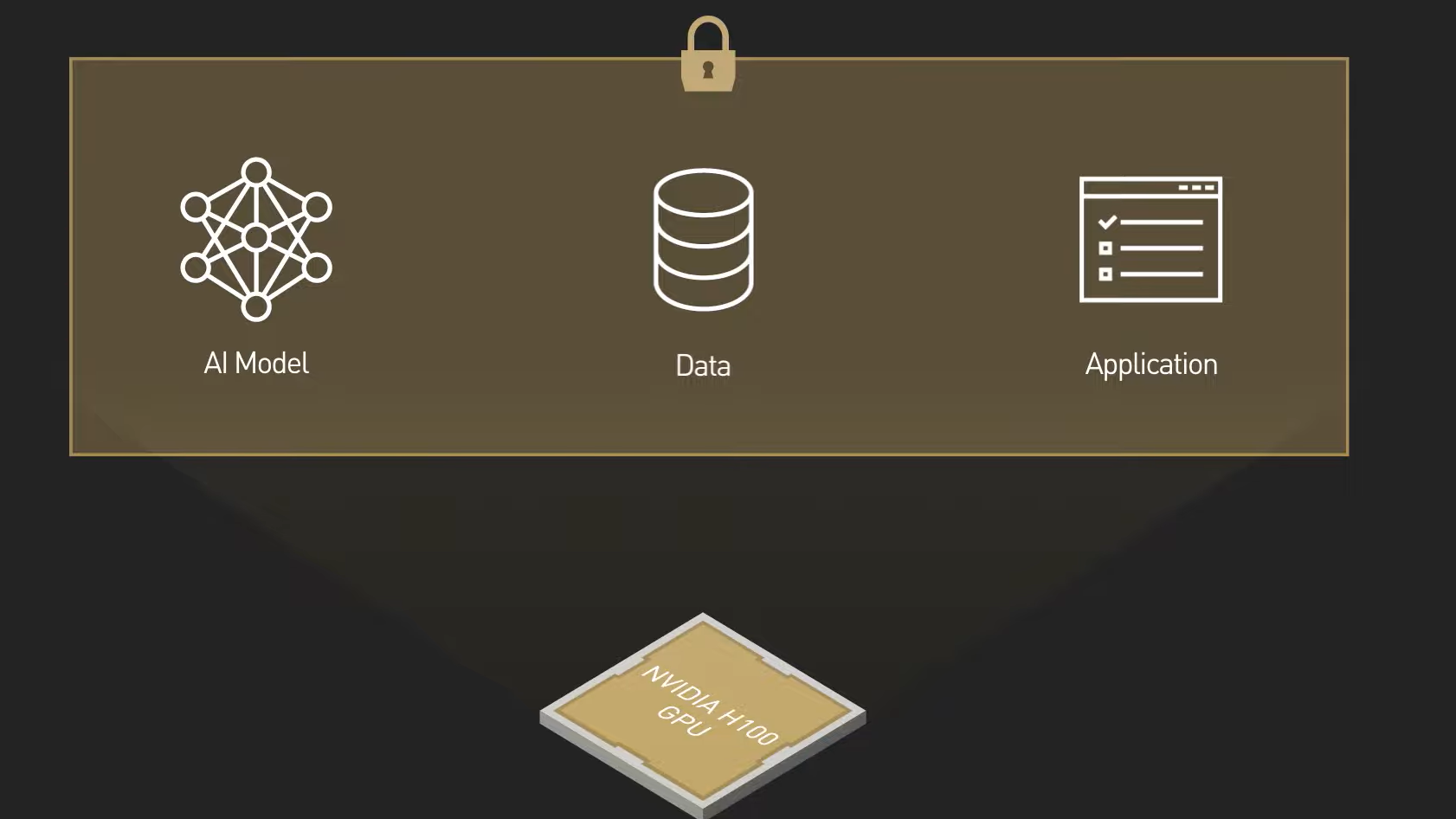

數據和人工智能 IP 通常在靜止(存儲)或通過網絡傳輸(傳輸)時通過加密和安全協議進行保護。但在使用過程中,例如在處理和執行它們時,由于未經授權的訪問或運行時攻擊,它們很容易受到潛在的破壞。

防止未經授權的訪問和數據泄露

機密計算通過在計算機處理器內的安全隔離環境(也稱為可信執行環境( TEE ))內執行計算,解決了保護使用中的數據和應用程序的這一缺口。

TEE 就像一個鎖著的盒子,保護處理器內的數據和代碼免受未經授權的訪問或篡改,并證明任何人都無法查看或操縱它。這為必須處理敏感數據或 IP 的組織提供了額外的安全層。

TEE 阻止系統管理程序、主機操作系統、基礎設施所有者(如云提供商)或任何能夠物理訪問服務器的人對數據和代碼的訪問。機密計算減少了來自內部和外部威脅的攻擊的表面積。它在計算堆棧的最底層保護數據和 IP ,并提供用于計算的硬件和固件值得信賴的技術保證。

今天的 CPU 保密計算解決方案不足以滿足 AI 工作負載的需求,因為這些工作負載需要加速以獲得更快的解決方案時間、更好的用戶體驗和實時響應時間。將 CPU 的 TEE 擴展到 NVIDIA GPU 可以顯著提高人工智能保密計算的性能,在保持強大安全措施的同時,能夠更快、更高效地處理敏感數據。

NVIDIA H100 上的安全 AI

機密計算是在NVIDIA H100 Tensor Core GPU使醫療保健、金融和公共部門等受監管行業的客戶能夠保護使用中的敏感數據和人工智能模型的機密性和完整性。

通過從計算堆棧的最低級別到 GPU 架構本身的安全性,您可以在本地、云中或邊緣使用 NVIDIA H100 GPU ‘構建和部署人工智能應用程序。在執行過程中,任何未經授權的實體都不能查看或修改數據和 AI 應用程序。這保護了敏感的客戶數據和人工智能知識產權。

有關 NVIDIA H100 中保密計算功能的快速概述,請參閱以下視頻。

解鎖安全 AI : NVIDIA H100 上的機密計算授權用例

NVIDIA H100 GPU 加速保密計算為企業提供了一個高性能、多功能、可擴展且安全的人工智能工作負載解決方案。它開啟了人工智能創新的新可能性,同時保持安全、隱私和法規遵從性。

- 機密人工智能培訓

- 機密人工智能推斷

- 面向 ISV 和企業的 AI IP 保護

- 機密聯合學習

機密人工智能培訓

在醫療保健、金融服務和公共部門等行業,用于人工智能模型培訓的數據是敏感和受監管的。這包括 PII 、個人健康信息( PHI )和機密專有數據,在培訓過程中,所有這些都必須受到保護,防止未經授權的內部或外部訪問。

借助 NVIDIA H100 GPU 上的保密計算,您可以獲得加快訓練時間所需的計算能力,并獲得數據和人工智能模型的機密性和完整性得到保護的技術保證。

對于在數據中心內部完成的人工智能培訓工作負載,機密計算可以保護培訓數據和人工智能模型不被惡意內部人員或任何組織間未經授權的人員查看或修改。當您在公共云等托管或共享基礎設施中訓練人工智能模型時,主機操作系統和系統管理程序會阻止對數據和人工智能模型的訪問。這包括服務器管理員,他們通常可以訪問由平臺提供商管理的物理服務器。

機密人工智能推斷

經過培訓后,人工智能模型將集成在企業或最終用戶應用程序中,并部署在本地、云中或邊緣的生產 IT 系統上,以推斷有關新用戶數據的信息。

向部署的人工智能模型提供的最終用戶輸入通常可以是私人或機密信息,出于隱私或法規遵從性原因,必須保護這些信息,以防止任何數據泄露或泄露。

人工智能模型本身是由人工智能產品或服務的所有者開發的有價值的 IP 。在推理計算過程中,它們有被查看、修改或竊取的風險,從而導致錯誤的結果和業務價值的損失。

通過保密計算在 NVIDIA H100 GPU 上部署人工智能應用程序,可以提供技術保證,即在推理過程中保護客戶輸入數據和人工智能模型不被查看或修改。這為最終用戶采用和使用人工智能服務提供了額外的信任層,并確保企業在使用過程中保護其寶貴的人工智能模型。

面向 ISV 和企業的 AI IP 保護

獨立軟件供應商( ISV )在為各種特定應用程序或特定行業的用例開發專有人工智能模型方面投入了大量資金。例子包括金融服務中的欺詐檢測和風險管理,或醫療保健中的疾病診斷和個性化治療計劃。

ISV 必須保護其 IP 在部署在本地客戶數據中心、邊緣遠程位置或客戶的公共云租賃內時不被篡改或竊取。此外,客戶需要保證他們作為 ISV 應用程序輸入提供的數據在使用過程中不會被查看或篡改。

NVIDIA H100 GPU 上的保密計算使 ISV 能夠將客戶部署從云擴展到邊緣,同時保護其寶貴的 IP 免受未經授權的訪問或修改,即使是對部署基礎設施有物理訪問權限的人。 ISV 還可以為客戶提供技術保證,即應用程序不能查看或修改他們的數據,從而增加客戶的信任并降低使用第三方 ISV 應用程序的風險。

機密聯合學習

為欺詐檢測、醫學成像和藥物開發等用例構建和改進人工智能模型需要多樣化、仔細標記的數據集進行培訓。這需要多個數據所有者之間的協作,而不會損害單個數據源的機密性和完整性。

NVIDIA H100 GPU 上的保密計算解鎖了保密聯合學習等安全多方計算用例。聯合學習使多個組織能夠合作訓練或評估人工智能模型,而不必共享每個小組的專有數據集。

NVIDIA H100 的保密聯合學習提供了額外的安全層,確保數據和本地人工智能模型在每個參與站點都受到保護,免受未經授權的訪問。

當部署在聯邦服務器上時,它還可以在聚合期間保護全局人工智能模型,并提供額外的技術保證層,以保護聚合模型免受未經授權的訪問或修改。

這有助于推動醫學研究的發展,加快藥物開發,減少保險欺詐,并在全球范圍內追蹤洗錢,同時維護所有相關方的安全、隱私和監管合規性。

NVIDIA 平臺,用于加速內部機密計算

在 NVIDIA H100 GPU 上開始使用機密計算需要支持基于虛擬機( VM )的 TEE 技術的 CPU ,如 AMD SEV-SNP 和 Intel TDX 。將基于虛擬機的 TEE 從支持的 CPU 擴展到 H100 GPU 可以對所有虛擬機內存進行加密,并且運行的應用程序不需要任何代碼更改。

頂級 OEM 合作伙伴現在正在運送由 NVIDIA H100 Tensor Core GPU 提供動力的機密計算加速平臺。這些機密計算兼容系統將 NVIDIA H100 PCIe Tensor Core GPU 與支持 AMD SEV-SNP 技術的 AMD Milan 或 AMD CPU 熱那亞相結合。

以下合作伙伴正在為企業提供第一波 NVIDIA 平臺,以確保其數據、人工智能模型和數據中心內部使用的應用程序的安全:

- ASRock 機架

- 飛馬座

- 思科

- 戴爾技術

- 千兆字節

- 惠普企業

- 聯想

- 超微

- 佳恩

NVIDIA H100 GPU 在第一個生產版本中附帶支持所有機密計算功能的 VBIOS (固件)。將于今年夏天發布的 NVIDIA 機密計算軟件堆棧將首先支持單個 GPU ,然后在后續版本中支持多個 GPU ‘和多實例 GPU 。

有關 NVIDIA 保密計算軟件堆棧和可用性的更多信息,請參閱6 月 29 日的 Unlock the Potential of AI with Confidential Computing on NVIDIA GPUs會議(軌道 2 ),? Confidential Computing Summit 2023。

?