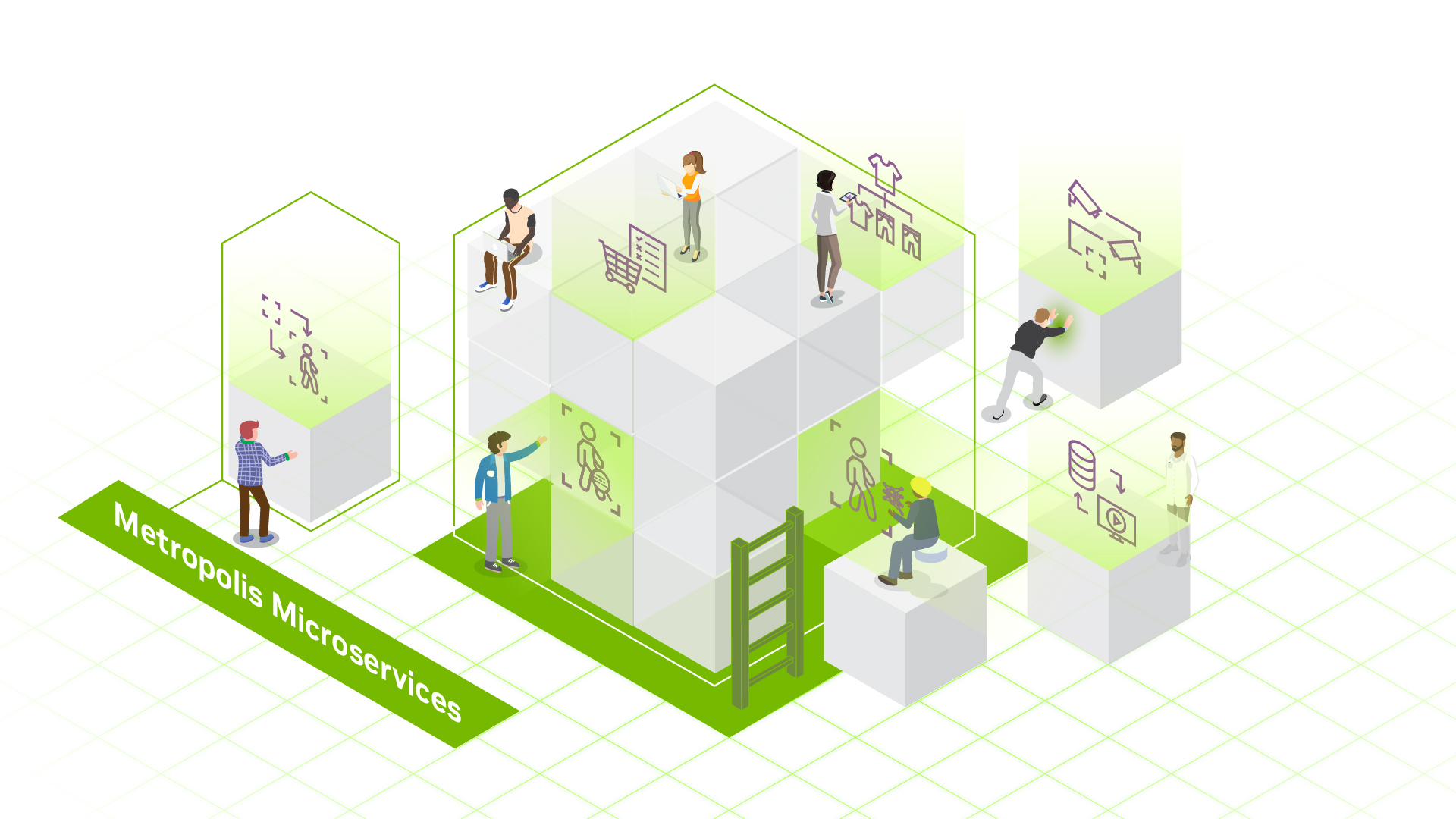

隨著視覺人工智能復雜性的增加,精簡的部署解決方案對優化空間和流程至關重要。NVIDIA 通過 NVIDIA Metropolis AI 工作流和微服務 加速開發,將想法在數周而非數月內轉化為現實。

在這篇文章中,我們將探討Metropolis 微服務的功能:

- 使用 NVIDIA Metropolis 微服務開發和部署云原生人工智能應用程序

- NVIDIA Isaac Sim 模擬和合成數據生成

- 使用 NVIDIA TAO Toolkit 進行 AI 模型訓練和微調

- 使用 PipeTuner 進行自動精度調整

視頻 1。從數字孿生到多攝像機跟蹤的端到端工作流程

使用 Metropolis 微服務和工作流開發并部署云原生人工智能應用程序

使用人工智能管理和自動化基礎設施具有挑戰性,尤其是對于超市、倉庫、機場、港口和城市等大型復雜空間。這不僅僅是為了擴大攝像頭的數量,而是構建視覺人工智能應用程序,可以智能地監控、提取見解,并在數萬或數十萬平方英尺空間內數百或數千臺攝像頭中突出顯示異常情況。

微服務架構通過將復雜的多攝像頭 AI 應用程序分解為更小、獨立的單元,并通過定義良好的 API 進行交互,從而實現其可擴展性、靈活性和彈性,這種方法實現了每個微服務的獨立開發、部署和擴展,使整個應用程序更加模塊化,更易于維護。

實時、可擴展的多攝像頭跟蹤和分析應用程序的關鍵組件包括以下內容:

- 多攝像機跟蹤模塊,用于聚合來自每個攝像機的本地信息,并維護整個場景中對象的全局 ID

- 用于行為分析和異常檢測的不同模塊

- 軟件基礎設施,如實時可擴展消息代理(例如 Kafka)、數據庫(例如 Elasticsearch)

- 連接需要按需元數據和視頻流的下游服務的標準接口

- 每個模塊都必須是云原生微服務,以使您的應用程序具有可擴展性、分布式和彈性

Metropolis 微服務為您提供強大、可定制的云原生構建塊,用于開發視覺人工智能應用程序和解決方案。它們使從邊緣到云的原型、構建、測試和擴展部署變得更容易、更快,并增強了彈性和安全性。加快您的路徑,以釋放從倉庫、超市到機場和道路的各種空間的商業洞察力。

有關微服務的更多信息和完整列表,請參閱 NVIDIA Metropolis 微服務文檔。

下一節將更詳細地介紹一些關鍵的微服務:

- 媒體管理

- 知覺

- 多攝像頭融合

媒體管理微服務

媒體管理微服務基于NVIDIA 視頻存儲工具包(VST),提供了管理相機和視頻的一種有效方式。VST 具有硬件加速的視頻解碼、流媒體和存儲功能。

它支持 ONVIF S-profile 設備的 ONVIF 發現,包括控制和數據流。您可以通過 IP 地址或 RTSP URL 手動管理設備。它同時支持 H264 和 H265 視頻格式。VST 是為安全性、行業標準協議和多平臺而設計的。

感知微服務

Perception 微服務從媒體管理微服務獲取輸入數據,并在各個流中生成感知元數據(邊界框、單攝像機軌跡、Re-ID 嵌入向量),然后將這些數據發送到下游的分析微服務,以進行進一步的推理和洞察。

該微服務是使用NVIDIA DeepStream SDK構建的。它提供了一種低代碼或無代碼的實時視頻人工智能推理方法,由預先構建的模塊和 API 抽象低級別的編程任務。 使用 DeepStream,您可以通過一個簡單的配置文件配置復雜的視頻分析管道,指定任務如對象檢測、分類、跟蹤等。

多攝像頭融合微服務

Multi-Camera Fusion 微服務聚合和處理多個相機視圖的信息,通過 Kafka(或任何具有類似消息模式的自定義源)從Perception 微服務獲取感知元數據,并從Camera Calibration Toolkit獲取外部校準信息作為輸入。

- 在微服務內部,數據進入行為狀態管理模塊,以維護先前批次的行為,并與來自傳入微批次的數據相連接,創建軌跡。

- 接下來,微服務執行兩步分層聚類,重新分配共存的行為并抑制重疊的行為。

- 最后,ID 合并模塊將單個對象 ID 合并為全局 ID,從而保持跨多個傳感器觀察到的對象的相關性。

Metropolis AI 工作流程

提供了參考工作流和應用程序,以幫助您評估和集成高級功能。

例如,多攝像機跟蹤(MTMC)工作流是視頻分析的參考工作流,它執行多目標、多攝像機跟蹤,并提供看到的唯一對象數量隨時間的變化。

- 應用程序工作流將實時攝像機饋送作為媒體管理微服務的輸入。

- 它通過 Perception 微服務執行對象檢測和跟蹤。

- Perception 微服務的元數據進入 Multi-Camera Fusion 微服務,用于跟蹤多個相機中的對象。

- 一個并行線程進入擴展的行為分析微服務,首先對元數據進行預處理,將圖像坐標轉換為世界坐標,然后運行狀態管理服務。

- 然后,數據進入行為分析微服務,該服務與 MTMC 微服務一起提供各種分析功能作為 API 端點。

- Web UI 微服務將結果可視化。

有關詳細信息,請參閱多攝像頭跟蹤快速入門指南。

接口攝像頭校準

在大多數 Metropolis 工作流中,分析都是在真實世界的坐標系中執行的。為了將相機坐標轉換為真實世界的坐標,提供了一個用戶友好的基于網絡的Camera Calibration Toolkit,其功能包括如下:

- 從 VMS 輕松導入相機

- 攝像機圖像和平面布置圖之間的參考點選擇界面

- 自檢的動態重投影錯誤

- ROI 和絆網的附加組件

- 上傳圖像或建筑地圖的文件

- 導出到 web 或 API

此直觀的工具包簡化了設置和校準攝像頭的過程,可與 Metropolis 工作流和微服務無縫集成。

2024 人工智能城市挑戰賽

NVIDIA 多攝像頭追蹤工作流程是使用第八屆2024 年人工智能城市挑戰研討會的多攝像頭人物追蹤數據集與 CVPR 2024 一起進行評估的,該數據集是該領域最大的數據集,包括 953 臺攝像機、2491 人和超過 100M 的邊界框,分為 90 個子集,其視頻的總持續時間為 212 分鐘,以每秒 30 幀的幀速率,以高清晰度(1080p)拍攝。

NVIDIA 方法獲得了 68.7%的 HOTA 得分,在 19 支國際球隊中排名第二(圖 9)。

此基準測試僅關注批處理模式下的準確性,在批處理模式中,應用程序可以訪問整個視頻。在在線或流操作條件下,應用程序只能訪問歷史數據,而不能訪問當前幀之后的數據。這可能會使一些提交的方法變得不切實際,或者需要對實際部署進行重大的重新架構設計。未考慮的因素包括以下幾個方面:

- 從輸入到預測的延遲

- 運行時吞吐量(給定計算平臺或預算可以運行多少流)

- 可部署性

- 可擴展性

因此,大多數團隊不必針對這些因素進行優化。

相比之下,多攝像頭跟蹤作為 Metropolis 微服務的一部分,必須考慮并優化所有這些因素,以實現在生產用例中部署實時、可擴展、多攝像頭跟蹤的準確性。

一鍵微服務部署

Metropolis 微服務支持在 AWS、Azure 和 GCP 上一鍵部署。部署工件和說明可在 NGC 上下載,因此您可以通過提供一些先決條件參數,在自己的云帳戶上快速啟動端到端的 MTMC 應用程序。每個工作流都打包了一個 Compose 文件,啟用使用 Docker Compose 進行部署。

對于邊緣到云的攝像機流,攝像機可以使用運行在邊緣的媒體管理客戶端(VST Proxy),將邊緣的攝像機連接到在任何云服務提供商中的 Metropolis 應用程序,以進行分析。

這種簡化的部署流程使您能夠在各種云平臺上快速原型化、測試和擴展視覺 AI 應用程序,從而減少將解決方案投入生產所需的時間和精力。

利用 Isaac Sim 進行仿真和合成數據生成

針對特定用例訓練人工智能模型需要多樣化、標記的數據集,這些數據集的收集往往成本高昂且耗時。通過計算機模擬生成的合成數據提供了一種具有成本效益的替代方案,可以減少訓練時間和費用。

模擬和合成數據在現代視覺人工智能開發周期中發揮著至關重要的作用:

- 生成合成數據并將其與真實數據相結合,以提高模型的準確性和可推廣性

- 通過多攝像頭跟蹤和分析幫助開發和驗證應用程序

- 調整部署環境,如提出優化的相機角度或覆蓋范圍

NVIDIA Isaac Sim無縫集成到合成數據生成(SDG)管道中,為增強人工智能模型訓練和端到端應用程序設計與驗證提供了一個復雜的伴侶您可以跨廣泛應用程序生成合成數據,從機器人和工業自動化到智能城市和零售分析。

Omni.Replicator.Agent(ORA)擴展在 Isaac Sim 中簡化了對人和自主移動機器人(AMRs)等 agent 的模擬,以及從包含它們的場景中生成合成數據。

ORA 提供具有默認環境、資產和動畫的 GPU 加速解決方案,支持自定義集成,它包括一個自動相機校準功能,生成與 Metropolis 微服務中的工作流程兼容的校準信息,如多相機跟蹤(MTMC)工作流程。

使用 TAO Toolkit 進行 AI 模型訓練和微調

Metropolis 微服務采用了一些基于 CNN 和 Transformer 的模型,這些模型最初在真實數據集上進行預訓練,并使用合成數據進行增強,以實現更穩健的泛化和罕見情況的處理。

- 基于 CNN 的模型:

- PeopleNet:基于 NVIDIA DetectNet_v2 架構,預訓練了超過 760 萬張圖像,包含超過 7100 萬個人對象。

- 基于變壓器的模型:

- PeopleNet-Transformer:使用 DINO 目標檢測器與 FAN-Small 特征提取器。預訓練于 OpenImages 數據集,并在擁有超過 1.5M 圖像和 27M 人對象的專有數據集上微調。

除了直接使用這些模型外,您還可以使用NVIDIA TAO Toolkit輕松微調自定義數據集,以提高準確性,并優化新訓練的模型,從而在幾乎任何平臺上提高推理吞吐量。TAO 工具包是建立在 TensorFlow 和 PyTorch 之上的。

使用 PipeTuner 進行自動精度調整

PipeTuner是一個旨在簡化人工智能管道調整的新的開發工具。

人工智能服務通常包含一系列用于推理和跟蹤的參數,找到最佳設置以最大限度地提高特定用例的準確性可能具有挑戰性。手動調整需要對每個管道模塊有深入的了解,而在廣泛的高維參數空間中變得不切實際。

PipeTuner 通過自動化識別最佳參數的過程來解決這些挑戰,以根據提供的數據集實現盡可能高的關鍵性能指標(KPI)。通過高效地探索參數空間,PipeTuner 簡化了優化過程,使其無需具有管道及其參數的技術知識即可訪問。

總結

Metropolis 微服務簡化并加速了從邊緣到云的原型設計、構建、測試和擴展部署過程,提高了彈性和安全性。微服務靈活、易于配置,零編碼,并與高效的 CNN 和基于轉換器的模型打包,以滿足您的需求。只需點擊幾下,即可將整個端到端工作流部署到公共云或生產中。

您可以使用 NVIDIA Isaac Sim、NVIDIA TAO Toolkit、PipeTuner 和 NVIDIA Metropolis 微服務輕松創建強大的實時多攝像頭 AI 解決方案,這個全面的平臺使您的企業能夠在廣泛的行業中釋放寶貴的見解并優化您的空間和流程。

有關更多信息,請參閱以下資源:

- 下載 NVIDIA Metropolis 微服務組件

- 更多“入門”資源

- NVIDIA Metropolis 微服務開發者指南

- 了解更多關于 AI 驅動的多攝像頭跟蹤用例。

- 訪問論壇以獲取技術支持。請注意,您必須首先使用此表格申請軟件訪問權限,論壇訪問權限將在軟件訪問獲得批準后授予。

?

?