Inference Performance

2025年 3月 20日

借助 NVIDIA TensorRT-LLM 提升 Microsoft Azure AI Foundry 的 Llama 模型性能

微軟與 NVIDIA 合作,宣布在其 Azure AI Foundry 平臺上實現 Meta Llama 系列模型的變革性性能提升。

1 MIN READ

2025年 3月 18日

隆重推出 NVIDIA Dynamo:用于擴展推理AI模型的低延遲分布式推理框架

NVIDIA 今天在 GTC 2025 宣布發布 NVIDIA Dynamo 。NVIDIA Dynamo 是一個高吞吐量、

4 MIN READ

2025年 3月 18日

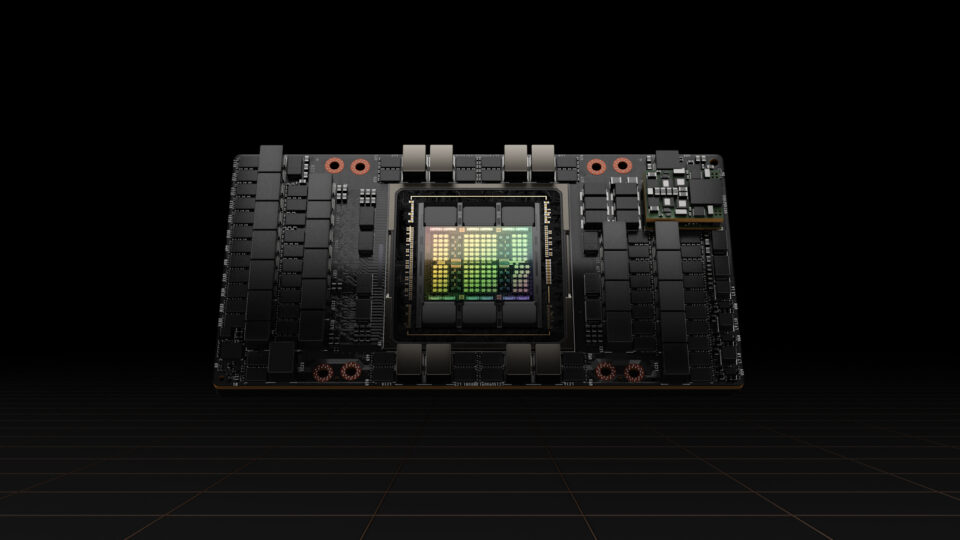

NVIDIA Blackwell 實現世界紀錄的 DeepSeek-R1 推理性能

NVIDIA 在 NVIDIA GTC 2025 上宣布了創下世界紀錄的 DeepSeek-R1 推理性能 。 搭載 8 個 NVIDIA…

5 MIN READ

2025年 2月 14日

使用 NVIDIA TensorRT-LLM 前瞻性解碼優化 Qwen2.5-Coder 吞吐量

專注于編碼的 大語言模型(LLMs) 已穩步應用于開發者工作流程。從配對編程到自我改進的 AI 智能體 ,這些模型可幫助開發者完成各種任務,

3 MIN READ

2024年 12月 24日

借助 NVIDIA 全棧解決方案提升 AI 推理性能

AI 驅動的應用的爆炸式發展對開發者提出了前所未有的要求,他們必須在提供先進的性能與管理運營復雜性和成本以及 AI 基礎設施之間取得平衡。

2 MIN READ

2024年 12月 18日

NVIDIA?TensorRT-LLM?現支持?Recurrent Drafting,實現?LLM?推理優化

Recurrent Drafting (簡稱 ReDrafter) 是蘋果公司為大語言模型 (LLM) 推理開發并開源的一種新型推測解碼技術,

2 MIN READ

2024年 12月 17日

借助 NVIDIA TensorRT-LLM 預測解碼,將 Llama 3.3 的推理吞吐量提升 3 倍

隨著近期新增的 Llama 3.3 70B (一種純文本指令調整模型),Meta 的開放 大語言模型 (LLMs) 集合將繼續增長。

4 MIN READ

2024年 12月 5日

聚焦:Perplexity AI 利用 NVIDIA 推理棧每月服務 4 億個搜索請求

對 AI 賦能服務的需求持續快速增長,這給 IT 和基礎設施團隊帶來了越來越大的壓力。這些團隊的任務是配置必要的硬件和軟件來滿足這一需求,

2 MIN READ

2024年 11月 19日

Llama 3.2 全棧優化釋放 NVIDIA GPU 的高性能

Meta 最近發布了 Llama 3.2 系列視覺語言模型(VLM),其中包含 11B 參數和 90B 參數變體。這些模型是多模態模型,

2 MIN READ

2024年 11月 15日

借助 NVIDIA TensorRT-LLM 分塊預填充提高 AI 推理效率和簡化部署

在本 博文 中,我們詳細介紹了分塊預填充,這是 NVIDIA TensorRT-LLM 的一項功能,

1 MIN READ

2024年 11月 8日

NVIDIA TensorRT-LLM KV 緩存早期重用實現首個令牌速度 5 倍提升

在上一篇 博客文章 中,我們展示了通過將鍵值 (KV) 緩存卸載到 CPU 內存來重復使用該緩存如何在基于 x86 的 NVIDIA…

2 MIN READ