TensorRT

2025年 4月 21日

使用 NVIDIA TensorRT 優化基于 Transformer 的擴散模型以生成視頻

先進的圖像擴散模型需要數十秒才能處理單張圖像。這使得視頻擴散更具挑戰性,需要大量計算資源和高昂成本。

4 MIN READ

2025年 4月 5日

NVIDIA 加速推理 Meta Llama 4 Scout 與 Maverick 模型

最新一代熱門 Llama AI 模型現已支持 Llama 4 Scout 和 Llama 4 Maverick。

2 MIN READ

2025年 4月 2日

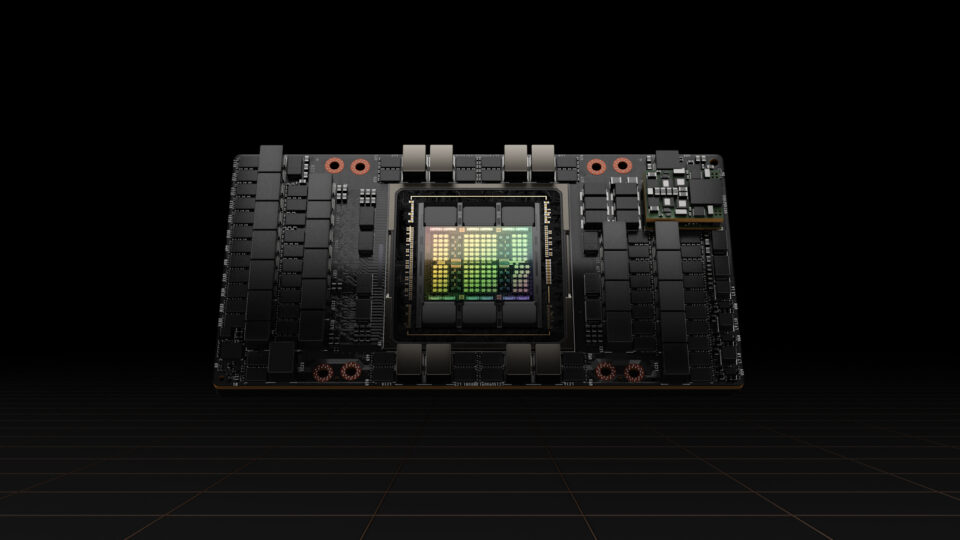

NVIDIA Blackwell 在 MLPerf Inference v5.0 中實現巨大的性能飛躍

在不斷增長的模型大小、實時延遲要求以及最近的 AI 推理的推動下, 大語言模型 (LLM) 推理的計算需求正在快速增長。與此同時,

3 MIN READ

2025年 3月 18日

NVIDIA Blackwell 實現世界紀錄的 DeepSeek-R1 推理性能

NVIDIA 在 NVIDIA GTC 2025 上宣布了創下世界紀錄的 DeepSeek-R1 推理性能 。 搭載 8 個 NVIDIA…

5 MIN READ

2025年 3月 18日

借助 NVIDIA DGX 云無服務器推理在云環境中無縫擴展人工智能

NVIDIA DGX Cloud Serverless Inference 是一種自動擴展 AI 推理解決方案,可實現快速可靠的應用部署。

3 MIN READ

2025年 3月 10日

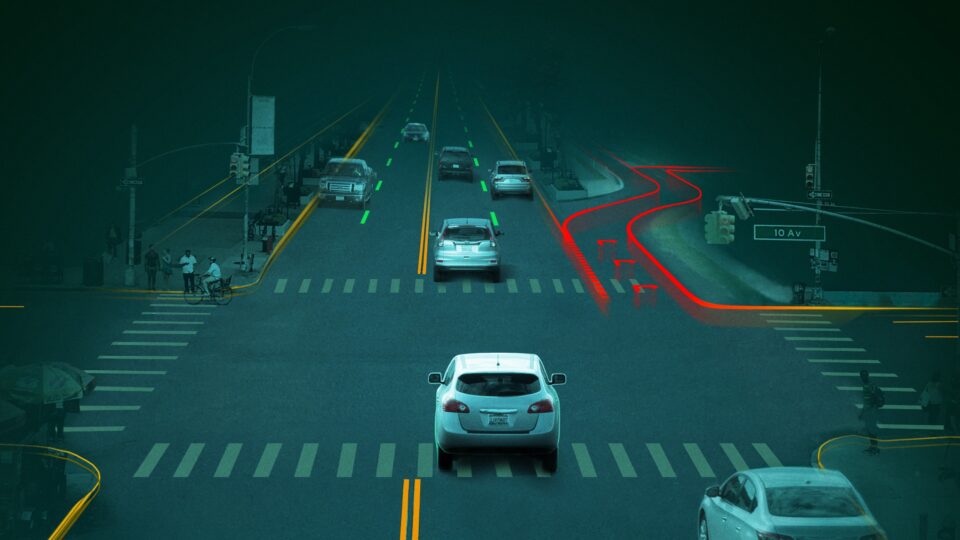

借助 NVIDIA DriveOS LLM SDK 簡化自動駕駛汽車應用的 LLM 部署

大語言模型 (LLMs) 在自然語言處理 (NLP) 中表現出非凡的泛化能力。它們廣泛應用于翻譯、數字助理、推薦系統、上下文分析、代碼生成、

2 MIN READ

2025年 2月 28日

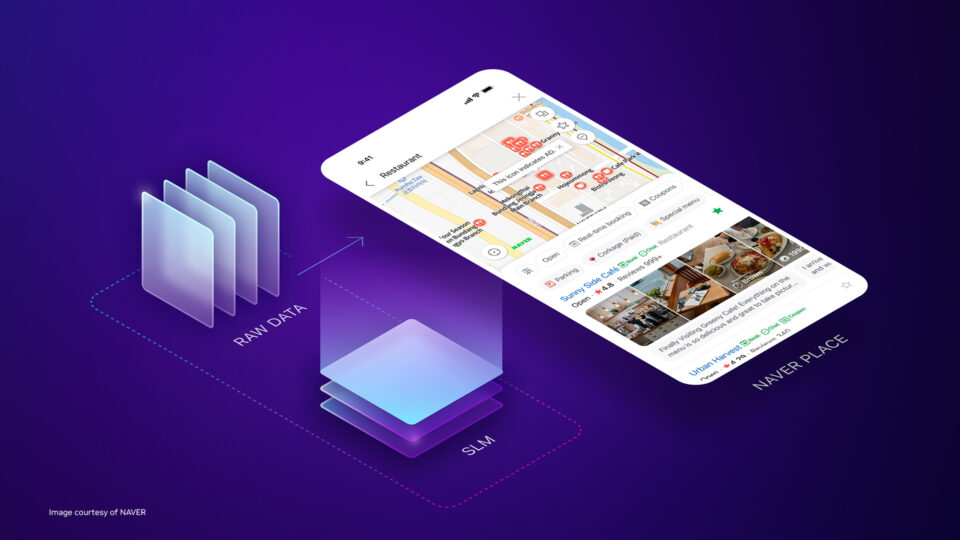

聚焦:NAVER Place 利用 NVIDIA TensorRT-LLM 優化 SLM 基礎的垂直服務

NAVER 是一家韓國熱門搜索引擎公司,提供 Naver Place ,這是一項基于地理的服務,可提供有關韓國數百萬家企業和興趣點的詳細信息。

4 MIN READ

2025年 1月 30日

為 NVIDIA Blackwell GeForce RTX 50 系列 GPU 發布全新 AI SDK 和工具

NVIDIA 最近宣布推出 新一代 PC GPU – GeForce RTX 50 系列 ,以及面向開發者的全新 AI 賦能 SDK 和工具。

2 MIN READ

2024年 12月 24日

借助 NVIDIA 全棧解決方案提升 AI 推理性能

AI 驅動的應用的爆炸式發展對開發者提出了前所未有的要求,他們必須在提供先進的性能與管理運營復雜性和成本以及 AI 基礎設施之間取得平衡。

2 MIN READ

2024年 12月 18日

NVIDIA?TensorRT-LLM?現支持?Recurrent Drafting,實現?LLM?推理優化

Recurrent Drafting (簡稱 ReDrafter) 是蘋果公司為大語言模型 (LLM) 推理開發并開源的一種新型推測解碼技術,

2 MIN READ

2024年 12月 11日

NVIDIA TensorRT-LLM 現支持動態批處理加速編碼器 - 解碼器模型

NVIDIA 最近宣布, NVIDIA TensorRT-LLM 現可加速編碼器 – 解碼器模型架構 。

1 MIN READ

2024年 11月 20日

TensorRT-LLM 低精度推理優化:從速度和精度角度的 FP8 vs INT8 的全面解析

本文將分享 TensorRT-LLM 中低精度量化內容,并從精度和速度角度對比 FP8 與 INT8。首先介紹性能,包括速度和精度。其次,

5 MIN READ

2024年 11月 19日

Llama 3.2 全棧優化釋放 NVIDIA GPU 的高性能

Meta 最近發布了 Llama 3.2 系列視覺語言模型(VLM),其中包含 11B 參數和 90B 參數變體。這些模型是多模態模型,

2 MIN READ

2024年 11月 15日

NVIDIA NIM 1.4 現已部署可用,推理速度提升 2.4 倍

隨著 生成式 AI 重塑各行各業,對可立即部署的高性能推理的需求也在不斷增長。 NVIDIA NIM 為 AI…

1 MIN READ

2024年 11月 8日

NVIDIA TensorRT-LLM KV 緩存早期重用實現首個令牌速度 5 倍提升

在上一篇 博客文章 中,我們展示了通過將鍵值 (KV) 緩存卸載到 CPU 內存來重復使用該緩存如何在基于 x86 的 NVIDIA…

2 MIN READ

2024年 11月 1日

NVSwitch 和 TensorRT-LLM MultiShot 共同加速 AllReduce 速度達 3 倍

在用戶數量可能在數百到數十萬之間波動,且輸入序列長度隨每個請求而變化的生產環境中,部署生成式 AI 工作負載會面臨獨特的挑戰。

1 MIN READ